diff --git a/.DS_Store b/.DS_Store

new file mode 100644

index 0000000..d3eb82c

Binary files /dev/null and b/.DS_Store differ

diff --git a/README.md b/README.md

index d092ed8..1acebcf 100644

--- a/README.md

+++ b/README.md

@@ -5,47 +5,37 @@

+这是我学习Java的知识总结,我会按照下面的技术栈一步步完善整个知识体系。

-**文章首发公众号**。如果有帮助到大家,希望点个**Star**!让我有持续的动力,感谢🤝

+分享给正在学习Java的你们,希望可以帮助你们少走一些弯路,一起学习进步!

-每周至少一篇的更新频率,没链接的是之后打算写的。

-

-:pencil2: [写作自述](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486050&idx=1&sn=1105d28b8d3553715f425419ec9d8d18&chksm=cf8479a7f8f3f0b19425e08a00332bbce4e5333843cfd6dd6f35e892139810d86b778cd57d55#rd)

+**文章首发公众号,每周至少一更。如果有帮助到大家,希望点个Star!让我有持续的动力,感谢🤝**

### :star: Java ###

- [深入详解ThreadLocal](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486776&idx=1&sn=f4425cb88bc5393e4d5125f5fd08ed68&chksm=cf847efdf8f3f7ebc79c5bcd3c47f1fc2f83abf119c2b22782cc90a1c69f606a95a4051dab53#rd)

-

- [使用Optional优雅避免空指针异常](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486914&idx=1&sn=b2b0f2c41b8168fbfcf1df21a3e00acb&chksm=cf847e07f8f3f711de06cb9269ba41541ec9399a56963768add081031566bf7fa49cbb6f7fa0#rd)

-

- [我画了35张图就是为了让你深入 AQS](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486172&idx=1&sn=b39cccd87dcd21176597dce0b15f7232&chksm=cf847919f8f3f00f86219d44cd95badee969d754aec89e644992437f2e8e0f7ad784695b4d90#rd)

-

- [一个 static 还能难得住我?](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486175&idx=1&sn=041c85c052c11d2d15243994bc46d90a&chksm=cf84791af8f3f00c90a18b29d1fa47c9bcd713651514fc5ce4a9f82d656fe637bb21d45c42be#rd)

-

- [原来这才是动态代理!!!](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486178&idx=1&sn=9610c1a0fa1df4c69558408ab2a3fcae&chksm=cf847927f8f3f0315b0c86f9b577926820c3d264d605149f850b597fcd17fafe432d82aaffcf#rd)

-

- [synchronized 的超多干货!](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486181&idx=1&sn=4cb9340ba2f19ccb19ccec0c54d61b86&chksm=cf847920f8f3f036cd752455290a97f6584f8a4ce9662d1102515dd5ed967c94e14cec7a767d#rd)

-

+- [ExecutorCompletionService详解](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487958&idx=1&sn=2ace7ac53d596cd909d1d1c7e96fbff2&chksm=cf846213f8f3eb05c9de1fab2c609f4774ca86497ad5542a26aae5928efd808bfd865738aa4f#rd)

+- [CompletableFuture深度解析](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247488046&idx=1&sn=2bb0b6dc4576278ff2e7f9b917cb6fe8&chksm=cf8461ebf8f3e8fd013d08c5028d41281444b1ac1d60f1706c841c4b444a4235d82c84644b9b#rd)

+- [面试官:响应式编程和虚拟线程怎么选?看完这篇不再被问倒](https://mp.weixin.qq.com/s/V7H_hyjycT3n1Rr7FBOrYQ)

### :page_facing_up: JVM ###

- [面试官:JVM是如何判定对象已死的?学JVM必会的知识!](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486087&idx=1&sn=c6f1a9932961095ffdf2aef8a789e115&chksm=cf847942f8f3f0549c798671fe804c93378586b4fc547cce14db2359852ff0723a3aab64a187#rd)

-

- [GC的前置工作,聊聊GC是如何快速枚举根节点的](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486168&idx=1&sn=9eef35ec701b5c2f8097641b7e69ae71&chksm=cf84791df8f3f00b1e85039f31b17e00bf9cb624bbee638efeca110e51df6c6b6ba6363705ee#rd)

-

- [GC面临的困境,JVM是如何解决跨代引用的?](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486242&idx=1&sn=83d4ace26fea86b0f16e93e25b3cdadf&chksm=cf8478e7f8f3f1f17a65a7fc0d25237e8f25b90f300085bb5a7e8128f7d80f5ba1a02e5a6c2f#rd)

-

- [昨晚做梦面试官问我三色标记算法](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486265&idx=1&sn=1464f25915c2c09ef65b784985b76fa3&chksm=cf8478fcf8f3f1ea80715ae949c1b4aec988368ead269c746d38244ae62028948a199f099d14#rd)

-

- [深入解析CMS垃圾回收器](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486628&idx=1&sn=984b273af7d1d0398517a2f5442ffb38&chksm=cf847f61f8f3f677372a5ebc9f81403a8324be1bed49bf92e763882715c943324de4f1b0139a#rd)

-

- [深入解析G1垃圾回收器](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486736&idx=1&sn=5e0710485783c3bcc4854a10412b9a40&chksm=cf847ed5f8f3f7c3826fa8c67bc76ce8dd218a725ee04f54cdafa27e14d190f5c92332589ae2#rd)

-

- [深入解析ZGC垃圾回收器](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486746&idx=1&sn=7257ecf8c36509d06be359e3889400f2&chksm=cf847edff8f3f7c96edc667051d9ef70537000202c1ec77699fa5e30e46c2c8ddabd122297f3#rd)

### :hammer: MySQL ###

-- [MySQL双写缓冲区(Doublewrite Buffer)](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247484456&idx=1&sn=b5154c5eb26b969655c1b430792e0cb6&chksm=cf8477edf8f3fefbe0c95c2074a461ab12c01926654d995ad7844cba332fda7744da6b47ddc5#rd)

+- [深入解析 MySQL 双写缓冲区](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487013&idx=1&sn=beae861ca0f148e010d4170d14f67fdd&chksm=cf847de0f8f3f4f631273fbc7b9739239772cf90ad94fe78e83eb006d6a700ba2f00faffac09#rd)

- [再深入一点|binlog和relay-log到底长啥样?](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486183&idx=1&sn=adc83df6c78e53ed1aefec7edc40ed63&chksm=cf847922f8f3f034beb08fc0a6fa2df8acb64902adff6927b71b5582e54444baa5c7265f7db8#rd)

@@ -53,29 +43,35 @@

- [听说你对explain 很懂?](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486188&idx=1&sn=4ebf475e7287e4b9cc0e37fdff0c18af&chksm=cf847929f8f3f03fba7173a17f8a04a677db9af91355cba552f5156b7fc9424ccf0fd87f8488#rd)

-- [MMR(Multi-Range Read Optimization)](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247484466&idx=1&sn=29b6a9adfa2fee52e6391509d1b8c73f&chksm=cf8477f7f8f3fee1ea1793924cf8475f7581a2770f8804a54a60c61f57aac4ce64dff723c308#rd)

+- [深入浅出MySQL MRR(Multi-Range Read)](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487041&idx=1&sn=66921cd6949db1389a0f02b3764b250f&chksm=cf847d84f8f3f4925b6506aeabe55308c85a68cb1fb8bf09aa99eca721d881246700bd9851a4#rd)

- [拿捏!隔离级别、幻读、Gap Lock、Next-Key Lock](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486190&idx=1&sn=c274fbc3daed3d1ac3a1ce5bd0009b68&chksm=cf84792bf8f3f03d07e2855570164cbfc0f0a7fbb0bba1fd50c8b7b2155c555c4438b625f395#rd)

-- [MySQL中的Join 的算法(NLJ、BNL、BKA)](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247484480&idx=1&sn=e75482a0fd8a866d9a9565aa9e659009&chksm=cf847785f8f3fe93195de380f7cff3efc8950a2cb49127a669f6b14a30e2fa5c13285e905f6b#rd)

+- [深入理解MySQL中的Join算法](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487068&idx=1&sn=042ab289718dbdaaea1b62854610efb7&chksm=cf847d99f8f3f48fd0aa04eeb2f6932bc826770f80911eec2fc571bdc7a50abc387714488d72#rd)

-- [MySQL分区表详解](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247484856&idx=1&sn=ffb350c8b1e74667fe15a5e808faec57&chksm=cf84767df8f3ff6b30ff91dd14a6f802eaac01076dcc8b988a18f1a529f21a6266d34e34c4d7#rd)

+- [MySQL分区表详解](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487126&idx=1&sn=d81d7fa7b2befa0637bc9df5f4292915&chksm=cf847d53f8f3f445c92c1ae37478e47be947829a70b68d1e0f7f7d74af2d7ee15e6fca657845#rd)

- [缓存和数据库一致性问题,看这篇就够了](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486196&idx=1&sn=e9dcd1824583546aada0096e457afda0&chksm=cf847931f8f3f02780828e9fb2b2f36d018d74583fb7091bdbe6b7565bdfa10a396b4bfa9965#rd)

+- [全网最详细MVCC讲解,一篇看懂](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487999&idx=1&sn=8abdf89c27bbedd788d6ea260cb981c3&chksm=cf84623af8f3eb2cd63c4f6f80fda0822d14c3bbf49487f254377f13963ccaf89b1d04344128#rd)

+

+- [六个案例搞懂间隙锁](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247488470&idx=1&sn=2a2b56e35ac6e1bae83e1a7eadc743f1&chksm=cf846013f8f3e9051b5e0d3636bcf135b994d77039409f92b7faeccdedddb6d5cfda6eaf0984#rd)

+

### :envelope: Redis ###

- [Redis类型(Type)与编码(Encoding)](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486922&idx=1&sn=98b7e28fc9ed20b69dc236605dfd1c34&chksm=cf847e0ff8f3f7197ece7d7b96c7fa82328d7e66b969a37246ac51f4c4dd21056540b046cbe6#rd)

+

+- [Redis性能优化:理解与使用Redis Pipeline](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486953&idx=1&sn=76365046920ead36714bbdf64300739b&chksm=cf847e2cf8f3f73ab5dc16d82817bde96a5ba5f16903896bae2943773df87a11153c612eeeb9#rd)

-- [布隆过滤器](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247484400&idx=1&sn=8d480b6b87ee2330e1e5f181fbf5f71a&chksm=cf847035f8f3f923699cd0b3c9137aa6bd596abd0242abe73abeee3179392794538e87e2dc42#rd)

+- [布隆过滤器:原理与应用](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487003&idx=1&sn=c98c8a0643ae56ac0d81572aeabcc279&chksm=cf847ddef8f3f4c86f14b317375e395124f9278e5dbd7daec854a8a342f77992f1e6b9775249#rd)

-- [Redis跟MySQL的双写问题](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247484390&idx=1&sn=de37dc02c20f3b471404c507c3741550&chksm=cf847023f8f3f935233feb3c575c7798e41d695347f11f502a75f25ba02b479ad152572c666e#rd)

+- [探索 Redis 与 MySQL 的双写问题](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486966&idx=1&sn=1aa2fc4d096242a8b725e01d45327a0c&chksm=cf847e33f8f3f72529da952b0621f7faf1756e5fd24e50c0d1896d98eab097e5bbf74aa218dd#rd)

- [Redis内存碎片:深度解析与优化策略](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486935&idx=1&sn=0b41d8807b6f0cdd06172f587884aa7a&chksm=cf847e12f8f3f70469ee692017388360a767175c9a3cbe482f2d93232c52540e43e5c8c8034e#rd)

-- [Redis中的BigKey问题:排查与解决思路](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247484415&idx=1&sn=39cb685de9880bbe8fb108518cd5d54d&chksm=cf84703af8f3f92ca802e8e567a1f9bcdd038574113fe7aa68091db9f32cd86f6957862ee83a#rd)

+- [Redis中的Big Key问题:排查与解决思路](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487157&idx=1&sn=9cc48fd498f6633fdc49c11f7cd6b88f&chksm=cf847d70f8f3f466319083703cff3623d0ec92a6d47d9594c4b0547d9489805dfefba2ecd179#rd)

-- [非看不可的Redis持久化](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247484435&idx=1&sn=e02f552e3d943787fdd5442ab49eb95a&chksm=cf8477d6f8f3fec05b7b8441cc19898bf9a4c4e9ffaa72827eba2e20735a0f37f840c4e2e495#rd)

+- [超详细!彻底说明白Redis持久化](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247488849&idx=1&sn=d15830cf43364a8c9e3c9292d53cce05&chksm=cf846694f8f3ef825cb84436e2c931d9e22c2cdf810a546a3edb301a539168e0ce33c868d115#rd)

- [深度剖析:Redis分布式锁到底安全吗?看完这篇文章彻底懂了!](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486194&idx=1&sn=59c36ccae0a67063e4b29aba5084ffe0&chksm=cf847937f8f3f0211b989c65ff07c8b142ddd7752592f018488cb852a9062b587bbe8b2b3d3e#rd)

@@ -84,28 +80,40 @@

- [Redis最佳实践:7个维度+43条使用规范,带你彻底玩转Redis | 附实践清单](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486200&idx=1&sn=52dc758e32d138efcba25a7a47aec23d&chksm=cf84793df8f3f02b497d68f6f9407f7681b7eda3b2c88c87ac0f0411a7d0df4cf2ec8b9ba781#rd)

- [颠覆认知——Redis会遇到的15个「坑」,你踩过几个?](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486202&idx=1&sn=5fee614b5272fb9e3522f446bddc6132&chksm=cf84793ff8f3f02961bdccd2310d052231bc3023cd609afe71d7e648bcda48aa2c57eed65371#rd)

-### :lock:Elasticsearch ###

-- [学好Elasticsearch系列-核心概念](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247485450&idx=1&sn=b23b362f8baac883e6a64b0cb05b184d&chksm=cf847bcff8f3f2d98ef829ff3f7c8cee59600b6b2c683564e2ab6af2c0547fc67b8ccbc837e9#rd)

-

-- [学好Elasticsearch系列-索引的CRUD](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247485479&idx=1&sn=eb2b57e78d1f08c398558b2f23063df0&chksm=cf847be2f8f3f2f4567bd65048aba533355c70733bef9a14580ffcfadd01678acf01d62a92f4#rd)

-

-- [学好Elasticsearch系列-Mapping](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247485492&idx=1&sn=e33d0689502b043723b0c2e4f0660a1d&chksm=cf847bf1f8f3f2e75fc2a8dd4542572f2dc7e4706f4817d2f9cd2ae18d3f28a1455da7873207#rd)

-

-- [学好Elasticsearch系列-Query DSL](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247485520&idx=1&sn=97803ad983c80a90158b5b9efabcc8b7&chksm=cf847b95f8f3f2839fec2550df3dccb55e91b5cadcfc11ea2e9e25b27a882aceb5dca5fe2b96#rd)

-

-- [学好Elasticsearch系列-分词器](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247485544&idx=1&sn=cfa20adbb5c7328ea0cab85966d95c02&chksm=cf847badf8f3f2bbefd1b9e893cccf10a24c2a83f8052b613c62c999566e4c8616fded236552#rd)

-

-- [学好Elasticsearch系列-聚合查询](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247485562&idx=1&sn=dd965afcd5697a152dae32d46e3996cd&chksm=cf847bbff8f3f2a91c7c75af03809359f7c9963c32e1da19b79939ccc283c46b3cf8038bd917#rd)

-

-- [学好Elasticsearch系列-索引的批量操作](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247485594&idx=1&sn=71da9fcc473e3891b19c37af782ae7cb&chksm=cf847b5ff8f3f249e7f42ccac125982aa3abd8617bb5cc5466b2c5d381dae51f4d76b9f11d3c#rd)

-

-- [学好Elasticsearch系列-脚本查询](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247485648&idx=1&sn=a0b075e6c2bad836a4c4eb6cacbaff5a&chksm=cf847b15f8f3f2033b5e18b8376b14205902898fb14c40a955a10619a74b1d35552a046dd7d1#rd)

+### :lock: Elasticsearch ###

+

+- [一起学Elasticsearch系列-核心概念](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487646&idx=1&sn=381af0374eb1d512046315164a541211&chksm=cf84635bf8f3ea4d650dc00e277d273d9a1e7358ae884b3cfedaf9d172cb1f44df7775bf355a#rd)

+- [一起学Elasticsearch系列-索引的CRUD](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487642&idx=1&sn=ea2cc5a3e0be25a0a81abe860b183f09&chksm=cf84635ff8f3ea49944ad35ee9bba7e60bf3f9c9c72d83c3d103403739d58a49fe2ff4779314#rd)

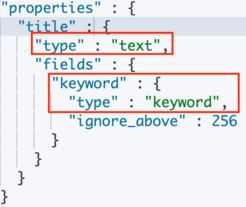

+- [一起学 Elasticsearch 系列 -Mapping](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487661&idx=1&sn=40c8a1a43c172c8500b975c6e1b35b39&chksm=cf846368f8f3ea7e451022e0e72b1a9d57c2641d56f9d0158fb8849d2806294e3dc7e3f71cde#rd)

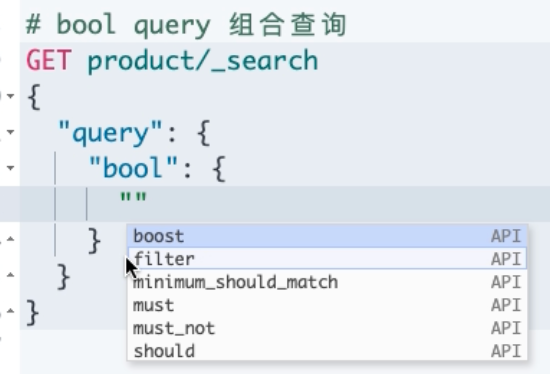

+- [一起学Elasticsearch系列-Query DSL](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487687&idx=1&sn=9622f7220358daab3a5dddd9fef3d2b7&chksm=cf846302f8f3ea147dac58d003d20495ce1feeec910423e59d917272e890590d7b769ec71510#rd)

+- [一起学 Elasticsearch 系列-分词器](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487710&idx=1&sn=bce31911a3259f77cd5f5874c255e74c&chksm=cf84631bf8f3ea0dd8c2b816950f1fe7f04f529abf02512ca778b8e2fa2b66b117f15d6d44bb#rd)

+- [一起学Elasticsearch系列-聚合查询](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487728&idx=1&sn=f4e43d386925b7cec5115fb388e00843&chksm=cf846335f8f3ea2371df0bfbb16b1f6c2dfb553d90762edd9bec9c2b9839f6043de4625c1a36#rd)

+- [一起学Elasticsearch系列-脚本查询](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487750&idx=1&sn=b7b7bdcc8736d4bfc2092bd5c3511084&chksm=cf8462c3f8f3ebd526b06d283b723844d548299957e4a8d1c5cf60e1a6fa70b5e97477f7cca8#rd)

+- [一起学Elasticsearch系列-索引的批量操作](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487779&idx=1&sn=54d06ae4f6a1aa62702cc61349e763b2&chksm=cf8462e6f8f3ebf026fe41fc0c8fb77b743687f0460a5eae970c2af95264e3556764911b2f1d#rd)

+- [一起学Elasticsearch系列-模糊搜索](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487791&idx=1&sn=5878be01f10e3834445c64cb6351a872&chksm=cf8462eaf8f3ebfcb0a49c57d68721448d649b1dfcd91f3af549ef1192c95fb6a00d25c386db#rd)

+- [一起学Elasticsearch系列-搜索推荐](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487818&idx=1&sn=ee11f629be04cf427193d0fee36bc6e2&chksm=cf84628ff8f3eb99baaa38cfcd126a5c11143a5e14e8571e33b1ddada1403001a7c955f1486f#rd)

+- [一起学Elasticsearch系列 -Nested & Join](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487856&idx=1&sn=d13fbb78f8093ef1ac85f4f4b4abe543&chksm=cf8462b5f8f3eba3ad95ad2cead38c8413565262917cb2a10c5f7c5287189f600a93014ffcca#rd)

+- [一起学Elasticsearch系列-深度分页问题](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487873&idx=1&sn=37c93764bd0ddad6c5d7a7b01d9eca3a&chksm=cf846244f8f3eb529197122f0bc15256c7cf865d1c2f7b23d2fee8dcd1259a5d02e2fc12da54#rd)

+- [一起学Elasticsearch系列-并发控制](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487882&idx=1&sn=9afba52dddff1e9a7269bc9dc23e4893&chksm=cf84624ff8f3eb597c445f21a71df24bc334d58b1108432fcf5acf92498cfb8a22fee07af059#rd)

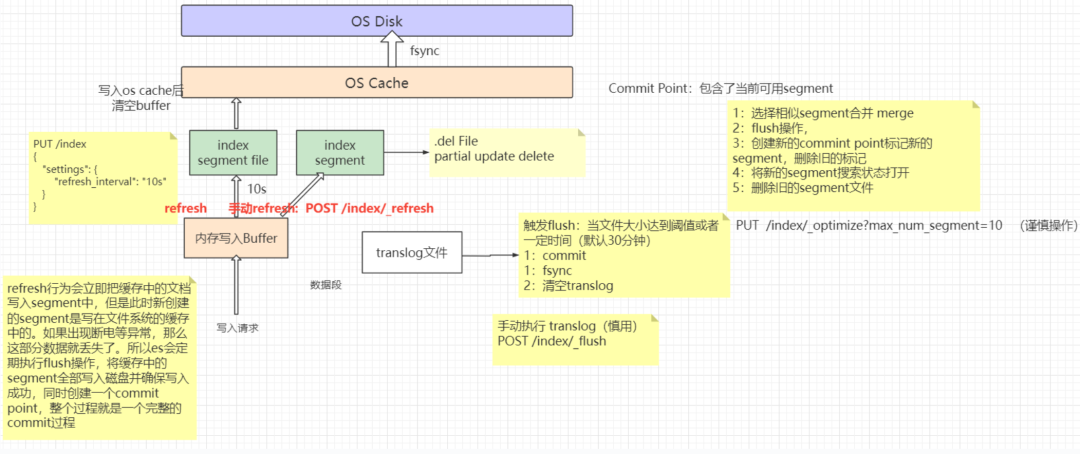

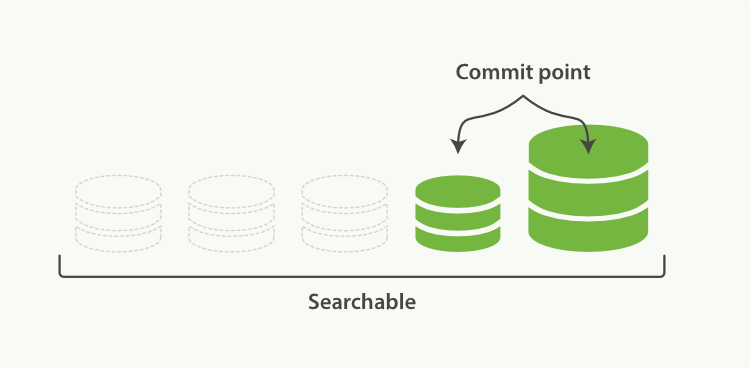

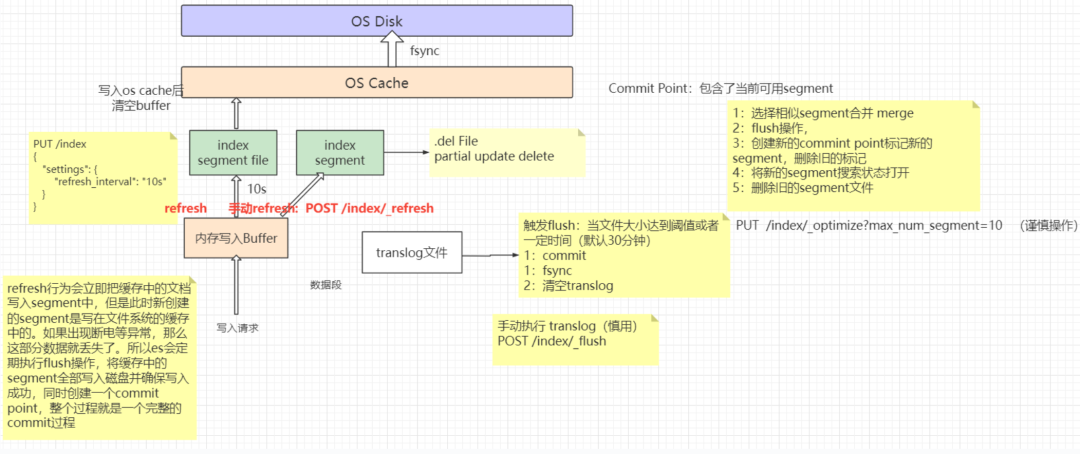

+- [一起学Elasticsearch系列-写入原理](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487898&idx=1&sn=b9960c61fb853619d1e52258cb5819a0&chksm=cf84625ff8f3eb492810d73713742b8459688fe7f9ef803354734bd9aceb7cdbc550a0ba6a17#rd)

+- [一起学Elasticsearch系列-写入和检索调优](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487903&idx=1&sn=45211a9d2b39c8433208f95af3ff3922&chksm=cf84625af8f3eb4c542e4b4082064e5abd2f2e21806a8f3e15409e02660afd820a4e5b854a9b#rd)

+- [一起学Elasticsearch系列-索引管理](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487926&idx=1&sn=3e7a6e6de02de000657b142d4bee5e82&chksm=cf846273f8f3eb656a9be4fa060dc23f1aba6ac3ca0b41087511a5787fe8b523a4c1db9bda15#rd)

+- [一起学Elasticsearch系列-Pipeline](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247488897&idx=1&sn=2d4adc6d38813efa5a66a4f7c2763375&chksm=cf846644f8f3ef52577656d9a6d9cf5dbaef7f6dc61d21df181c61279237380f9ddd111fad69#rd)

+

+### :mag_right: DDD ###

+

+- [熬夜整理的2W字DDD学习笔记](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247489048&idx=1&sn=6dc6f884fe7ca0e07d86aaa6e37ba4ab&chksm=cf8465ddf8f3eccbae516e3405dff032dfcc0c2820b187f4188caca2e63bed88d99fbb11b8c1#rd)

-### :date:框架 ###

+### :birthday: Spring ###

+

+- [如何优雅地Spring事务编程](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247489087&idx=1&sn=60d6e29a87753beb69754bb633cbfe6e&chksm=cf8465faf8f3ececad33d8f42a7644e44eb05081c613761b39fc4bf46425058e9e3e5bbcf52b#rd)

+

+### :date: 框架 ###

- [本地缓存无冕之王Caffeine Cache](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486885&idx=1&sn=37c7a9461402bd97822295cf51361777&chksm=cf847e60f8f3f776eb3b477decfbac55dc8b7ae1cf607ef68fbee89dbe02d40a800a92fabec7#rd)

+- [响应式编程不只有概念!万字长文 + 代码示例,手把手带你玩转 RxJava](https://mp.weixin.qq.com/s/r0DJiOxR8wnZZ6tIKrSPzg)

-### :fire:架构设计 ###

+### :fire: 架构设计 ###

- [高并发系统设计之负载均衡](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486811&idx=1&sn=5422c62878ee1ddcc6ee1da45deb78d7&chksm=cf847e9ef8f3f7889c94fe93796c87083ebb47680ef13b40a35f5127c293e5d44fd3621abd57#rd)

@@ -115,22 +123,67 @@

- [搞懂异地多活,看这篇就够了](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486192&idx=1&sn=6c82786cf2403486d81f375be684f228&chksm=cf847935f8f3f023a167ea3272a35979ee623dd0207acb70a0898148a1b18a15df01a49e54d8#rd)

-### :dash:编程语言 ###

+- [12306技术内幕](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247489137&idx=1&sn=9f5857733a5bed241902fb4c4421adf3&chksm=cf8465b4f8f3eca2d7d65af8cd8a1b3e9b1b3b56d482eb09cdd5fdd0ae3b7744a3994c495cbf#rd)

-- [Scala初学者指南](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247484574&idx=1&sn=85ac7b748ec8f22e3e8f8f42efca02d1&chksm=cf84775bf8f3fe4d2779871e106e1946293bb57d6f85ad44aa1f20fe467e9402a26807a532b4#rd)

-

-- [Groovy初学者指南](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247484641&idx=1&sn=7243e662d2b0a811f1be745777c30420&chksm=cf847724f8f3fe329f4414fb3fa9c262e0d2985f6996b64b519b79b1c6ae3f65fb894d27bb76#rd)

+- [业务幂等性设计的六种方案](https://mp.weixin.qq.com/s/HZAkGPNrC05aeHabhqT-zA)

-### :eyes:大数据 ###

+### :dash: 编程语言 ###

-- [Spark入门这篇就够了(万字长文)](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247484731&idx=1&sn=033b31376869f2046219dfe28707e43d&chksm=cf8476fef8f3ffe86a1910e5948afddba464e6cc186adb3ecb8ca62f612a4110b71ada2370cc#rd)

-

-- [一篇文章带你入门HBase](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247484823&idx=1&sn=4f8204e007c2201962cd707fc5668242&chksm=cf847652f8f3ff443ef516bf490656b21891eee42382970435a25451948daf89c2d72cfad96f#rd)

-

-- [全网最详细4W字Flink入门笔记(上)](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247485174&idx=1&sn=4cbd4ce941458fa576febb5021d1942f&chksm=cf847533f8f3fc25fa6e9c0c6de69b68b3f424aad52e6846dca8641d11a8be7ea8614682ad64#rd)

+- [Scala语言入门:初学者的基础语法指南](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487245&idx=1&sn=d089e22890f1f7449b7cf34e3cf2f6ed&chksm=cf847cc8f8f3f5deb39556f4229bafb6f1498906dc1d75040f90817bf0396117a7c2cdb498f9#rd)

+- [Groovy 初学者指南](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487066&idx=1&sn=da9e3a9aff377d383e34e537e2f55666&chksm=cf847d9ff8f3f489011f26a784302ee68b9c1d7d57d52bc2c924a7c9b1a5f528ef2a417114c0#rd)

+- [自研 DSL 神器:万字拆解 ANTLR 4 核心原理与高级应用](https://mp.weixin.qq.com/s/nFiEqhi1B_SxrZGCAqLgLw)

+

+### :satellite: 设计模式 ###

+

+- [一文搞懂设计模式—策略模式](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247488583&idx=1&sn=2e4758ee1b48dc5884289d5ecb841491&chksm=cf846782f8f3ee946d514e6267a326facb6880002fb663ffdbc3347e1d89fab32b8c0f5764d9#rd)

-- [全网最详细4W字Flink入门笔记(下)](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247485365&idx=1&sn=c99d1e392440cad85342fdc950afc7f9&chksm=cf847470f8f3fd6632b34a42d8008f94430902630e4f5c8fb6ead1475facdc6e4ab39a5f828b#rd)

+- [一文搞懂设计模式—责任链模式](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247488600&idx=1&sn=dd004bacfe0262fcc0fd1d72ae506b7a&chksm=cf84679df8f3ee8bf7117c5bed745470475c1a35ee96fe2bb99e093d895b7b776ecf51bb31c2#rd)

+

+- [一文搞懂设计模式—单例模式](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247488615&idx=1&sn=1f0f92f6180856dbf206706c071438a3&chksm=cf8467a2f8f3eeb4e24e6c42f7f8cd265c03939ffa7742d1445ed7dddc6b11bb63aa6b0eb95e#rd)

+

+- [一文搞懂设计模式—观察者模式](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247488718&idx=1&sn=9486e6b494c666e805e321a74bac5591&chksm=cf84670bf8f3ee1da0e7f26963e007da8fa77e7190596c9a6f6296cf2cc70af2ec4c066b5906#rd)

+

+- [一文搞懂设计模式—门面模式](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247488730&idx=1&sn=0f63b2f54615d0647d4be22964dadea2&chksm=cf84671ff8f3ee0900b2cd3174ab8e66131308049648cc4e65d25215a54cc457cea1e73c8698#rd)

+

+- [一文搞懂设计模式—工厂方法模式](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247488747&idx=1&sn=025c94f5b66b4dae3ab6f62dc043a083&chksm=cf84672ef8f3ee38bfce967135b5d23a93c0d59ae502b06b3c85ac629e336d28a21f1e13784f#rd)

+

+- [一文搞懂设计模式—模板方法模式](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247488758&idx=1&sn=40385dc2cd049ab06c6403c47e1d5efa&chksm=cf846733f8f3ee2596eb459b9114e654e5ffd0ca1565931b742c65879a8603fc75c74880be58#rd)

+

+- [一文搞懂设计模式—适配器模式](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247488766&idx=1&sn=78bf2e392394bb28272cceb3dd300618&chksm=cf84673bf8f3ee2d8b6308d272e8cd3a0173bfd540639cd7c17c4c40f6bc3e25561a0889930d#rd)

+

+- [一文搞懂设计模式—装饰器模式](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247488773&idx=1&sn=287d0323b84eec284a56edceb1e5840e&chksm=cf8466c0f8f3efd6e8a8e5270ed10cf991c7b27a93521359274c2120d9e45e29b637e948650f#rd)

+

+- [一文搞懂设计模式—代理模式](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247488866&idx=1&sn=d293faa2c918d85cc9cd8f6bc408b5a1&chksm=cf8466a7f8f3efb11ae68d7f7712bb22ceafae6f9d0529c235a1b1e02d183296c400211910b2#rd)

+

+- [一文搞懂设计模式—享元模式](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247488879&idx=1&sn=2cb5edc9bbb088fd6de2bf9d46cb76cf&chksm=cf8466aaf8f3efbce988a6bf96035714e5125ba8ddc6cfe02871ca73e61c814271608576ff13#rd)

+

+

+### :eyes: 大数据 ###

+

+- [Spark入门指南:从基础概念到实践应用全解析](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487398&idx=1&sn=077859e1109e07b1469d242ec2b8091a&chksm=cf847c63f8f3f575e50012ef3667d9724998f07e32ebd27b6e3a37c5bdf2251d02e89030cff0#rd)

+

+- [HBase入门指南](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487105&idx=1&sn=2ee82c9b239aa502bd3dffcf320b3f93&chksm=cf847d44f8f3f452e1b8ac83b9f62f380e349615b67da92343539d4014077c2ad9e787e256cc#rd)

+

+- [全网最详细4W字Flink全面解析与实践(上)](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487459&idx=1&sn=a1826b2d592fff29b5e11a374468796a&chksm=cf847c26f8f3f53073cc24584264fa2752a26c98bbd31c86bcf519296789eff05d72904d27ac#rd)

+

+- [全网最详细4W字Flink全面解析与实践(下)](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487535&idx=1&sn=736f1adda56cc550191f17e7111598b5&chksm=cf8463eaf8f3eafc38819e342705df1884683e03d5d39e9df876834ab0a84f61cc55923a5a03#rd)

+

+### :watch:AI

+

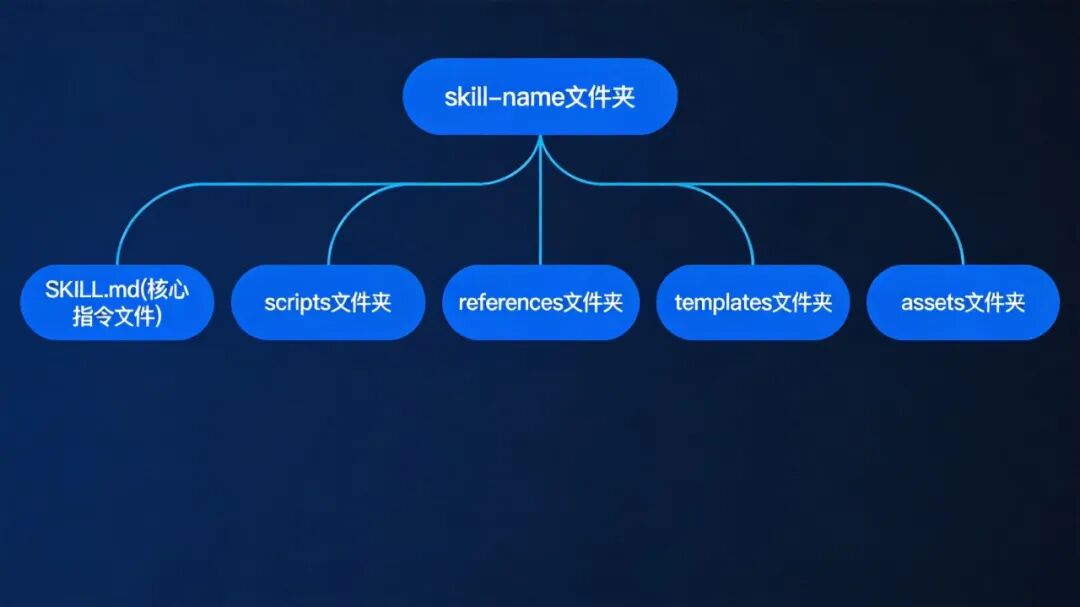

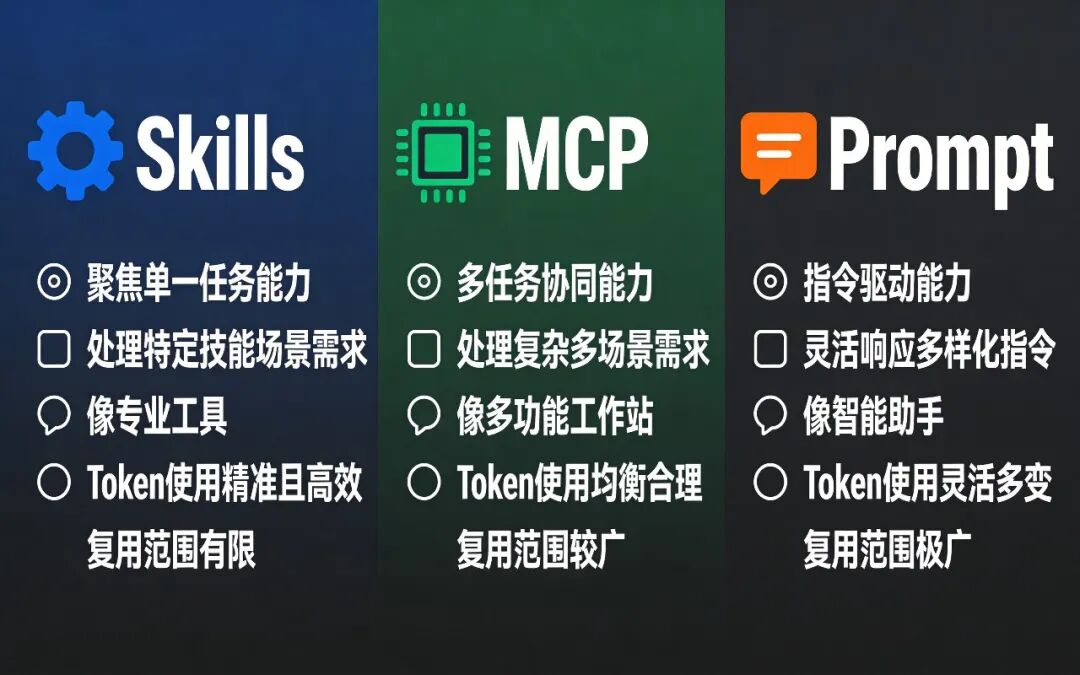

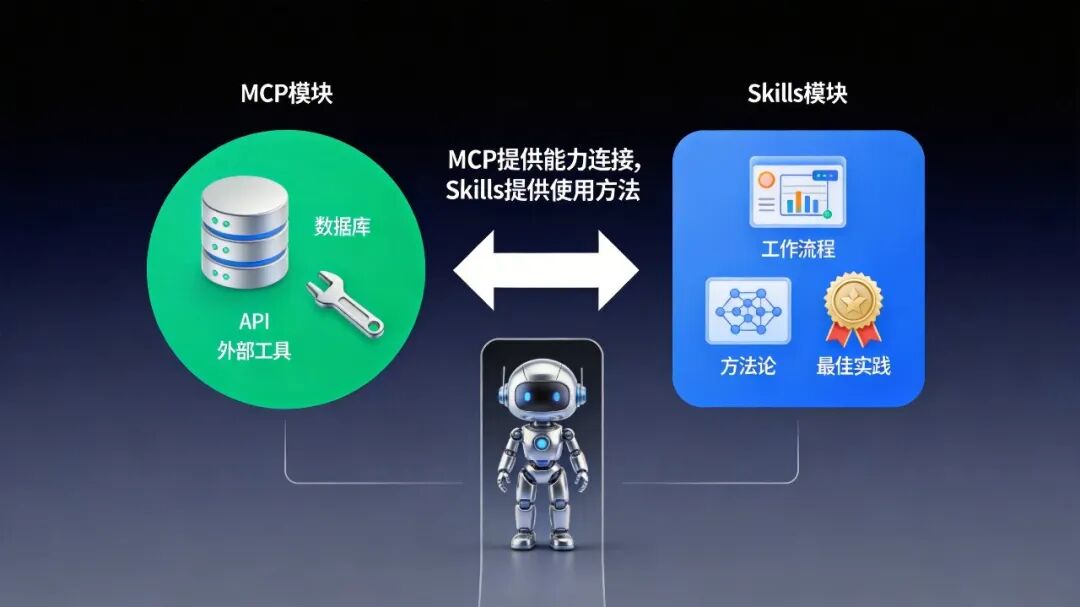

+- [深度解析Skills:从Prompt到能力复用的技术革命](https://mp.weixin.qq.com/s/Se6_L1PbhlEUGaBSY8sZsQ)

+- [为什么ChatGPT能听懂你说的话?Embedding技术揭秘](https://mp.weixin.qq.com/s/CoHcpXIaamdfmXCf-3qlgw)

+- [RAG详解:让大模型看见你的私有知识](https://mp.weixin.qq.com/s/mAC3DeqPLM41LyfGh2QjUw)

+- ReAct:让大模型学会边想边做

+- 10分钟掌握 JSON-RPC 协议,面试加分、设计不踩坑

+

+

+### :jack_o_lantern: 其他 ###

+- [良心推荐!几款收藏的神级IDEA插件分享](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247488457&idx=1&sn=f771ccebb84f226e7302b89caa5c056b&chksm=cf84600cf8f3e91aab4564d91feacb8822b53a2b3a79547439d64d2c0b7b293435a1ae79f994#rd)

+- [实战Arthas:常见命令与最佳实践](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247488559&idx=1&sn=4b5003cb33446ab4a6173285fe9d83d3&chksm=cf8467eaf8f3eefc033de8f63cba9f0d7b2b5eb0ccfb5209f458a9ab447367b34954f296638b#rd)

+- [Maven实战](https://mp.weixin.qq.com/s/ErtWrRNzjJcR2ettUhAxsQ)

+- [不用Mockito写单元测试?你可能在浪费一半时间](https://mp.weixin.qq.com/s/NICubD9Yq0pn6qwpVIznfg)

+- [用好PowerMock,轻松搞定那些让你头疼的单元测试](https://mp.weixin.qq.com/s/rWIjqJKBQOe72RWW6qyJmA)

### :bulb: 资源 ###

diff --git a/docs/.DS_Store b/docs/.DS_Store

new file mode 100644

index 0000000..1b0a35f

Binary files /dev/null and b/docs/.DS_Store differ

diff --git a/docs/md/.DS_Store b/docs/md/.DS_Store

new file mode 100644

index 0000000..e79a8fe

Binary files /dev/null and b/docs/md/.DS_Store differ

diff --git "a/docs/md/AI/10\345\210\206\351\222\237\346\216\214\346\217\241 JSON-RPC \345\215\217\350\256\256\357\274\214\351\235\242\350\257\225\345\212\240\345\210\206\343\200\201\350\256\276\350\256\241\344\270\215\350\270\251\345\235\221.md" "b/docs/md/AI/10\345\210\206\351\222\237\346\216\214\346\217\241 JSON-RPC \345\215\217\350\256\256\357\274\214\351\235\242\350\257\225\345\212\240\345\210\206\343\200\201\350\256\276\350\256\241\344\270\215\350\270\251\345\235\221.md"

new file mode 100644

index 0000000..f4328dd

--- /dev/null

+++ "b/docs/md/AI/10\345\210\206\351\222\237\346\216\214\346\217\241 JSON-RPC \345\215\217\350\256\256\357\274\214\351\235\242\350\257\225\345\212\240\345\210\206\343\200\201\350\256\276\350\256\241\344\270\215\350\270\251\345\235\221.md"

@@ -0,0 +1,291 @@

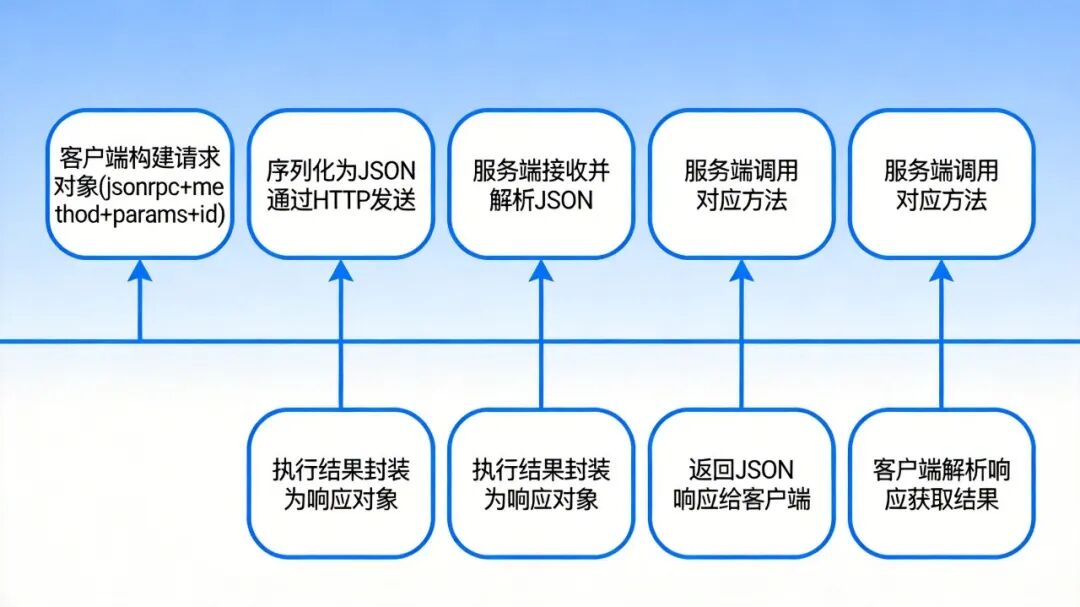

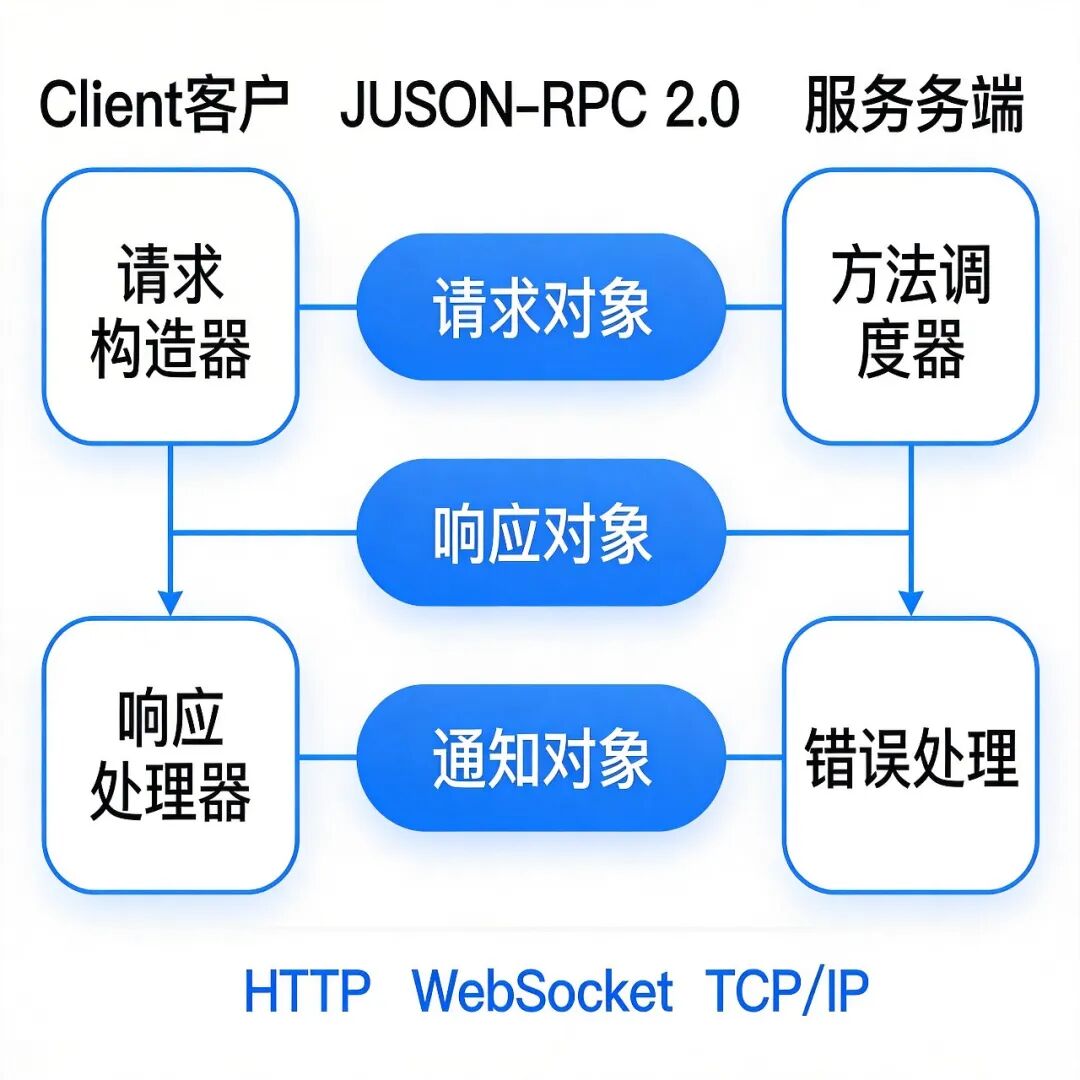

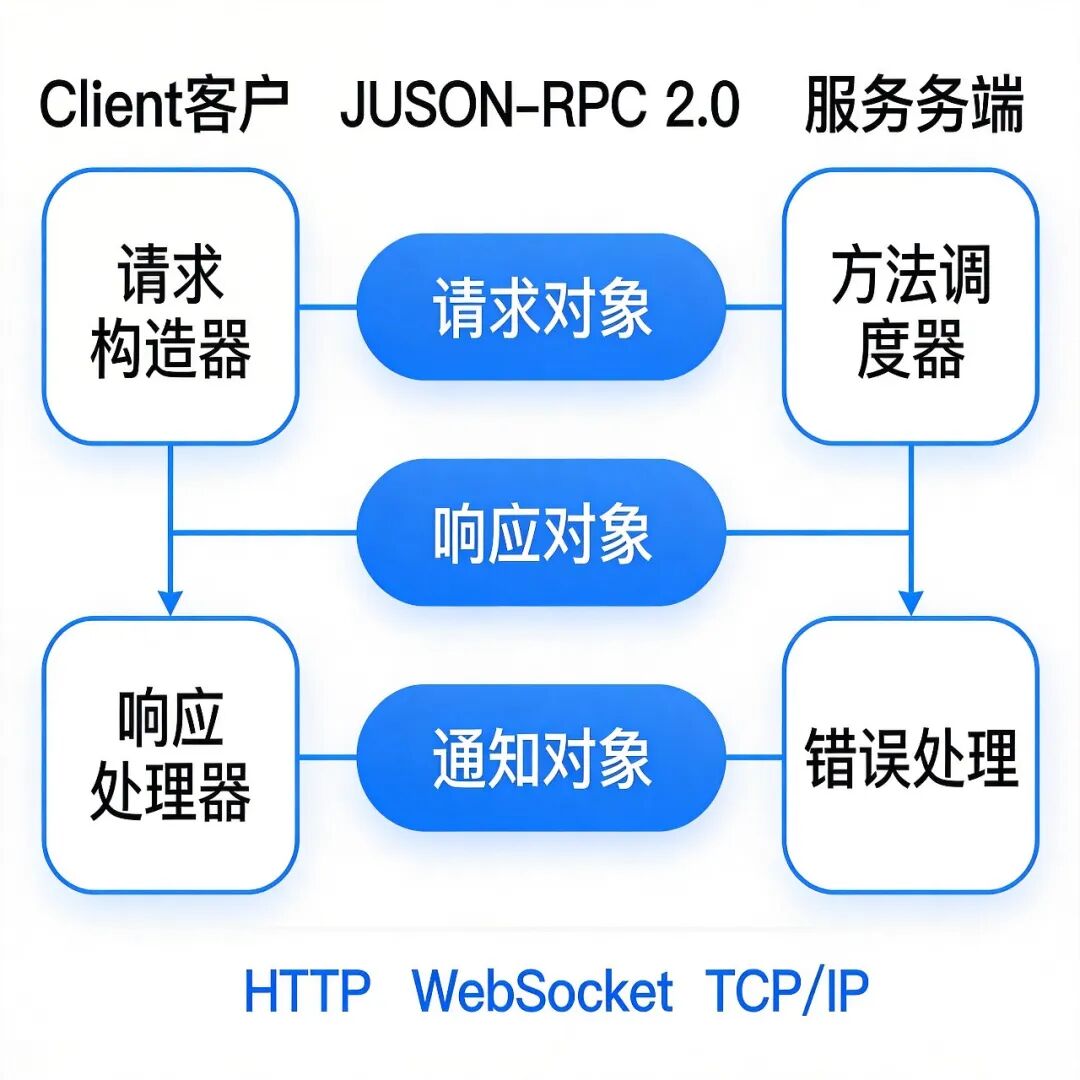

+分布式系统中,不同服务之间需要一种可靠的方式来通信。远程过程调用(RPC)是一种常见的选择,而 **JSON-RPC** 是其中比较简单的一种。

+

+这篇文章介绍 JSON-RPC 2.0 协议的核心内容,包括消息格式、错误处理和实际应用场景。

+

+## JSON-RPC 概述

+

+### 什么是 JSON-RPC

+

+JSON-RPC 是一种无状态、轻量级的远程过程调用协议,使用 JSON 作为数据格式。它的设计目标就是简单——协议规范只有几页文档。

+

+JSON 作为数据交换格式,几乎所有主流编程语言都有良好的支持,包括 JavaScript、Python、Java、C#、Go 等。这使得 JSON-RPC 能够轻松实现跨语言调用。

+

+协议本身不绑定传输层,可以跑在 HTTP、WebSocket、TCP Socket 等各种消息传输环境上。开发者可以根据业务需求选择合适的传输方式。

+

+### JSON-RPC 的发展历程

+

+JSON-RPC 有两个主要版本:1.0 和 2.0。

+

+1.0 版本最早提出了基于 JSON 的 RPC 概念,但在规范性方面有所欠缺。2010 年发布的 2.0 版本做了重要升级,加入了批量调用支持、统一的错误对象结构。两个版本通过 `jsonrpc` 字段来区分。

+

+### JSON-RPC 的核心特点

+

+JSON-RPC 有几个值得注意的特点:

+

+- **简洁性**:规范文档很短,请求和响应结构清晰明了。

+- **跨语言支持**:任何能解析 JSON 的语言都可以实现 JSON-RPC 客户端或服务端。

+- **无状态设计**:每个请求独立,协议不维护会话状态。这种设计简化了服务端的实现,也更容易水平扩展。

+- **批量处理能力**:2.0 版本支持在单个请求中包含多个 RPC 调用,服务端返回结果数组。

+- **双向通信**:通过长连接和通知机制,JSON-RPC 也支持服务端主动向客户端推送消息。

+

+## 协议规范详解

+

+### 协议约定与术语

+

+JSON-RPC 规范中使用了 RFC 2119 定义的关键字:MUST、MUST NOT、SHOULD、SHOULD NOT、MAY。这些术语描述了实现者必须、应该或可以遵循的行为规范。

+

+**客户端(Client)**:发起请求的实体,负责构造请求对象并处理响应。

+

+**服务端(Server)**:接收请求并返回响应的实体,处理请求并生成响应。

+

+同一个实现可以同时扮演客户端和服务端。比如在对等网络中,两个节点可能既向对方发起请求,也响应来自对方的请求。

+

+### 数据类型系统

+

+JSON-RPC 继承自 JSON 的类型系统,包含六种数据类型:

+

+基本类型:String(字符串)、Number(数值)、Boolean(布尔值)、Null(空值)

+

+结构化类型:Object(对象)、Array(数组)

+

+这些类型名称首字母必须大写,包括 True 和 False。

+

+成员名称(字段名)在客户端与服务端之间交换时必须区分大小写。函数、方法、过程这三个术语可以互换使用,都指向可以被调用的可执行单元。

+

+## 消息格式深度解析

+

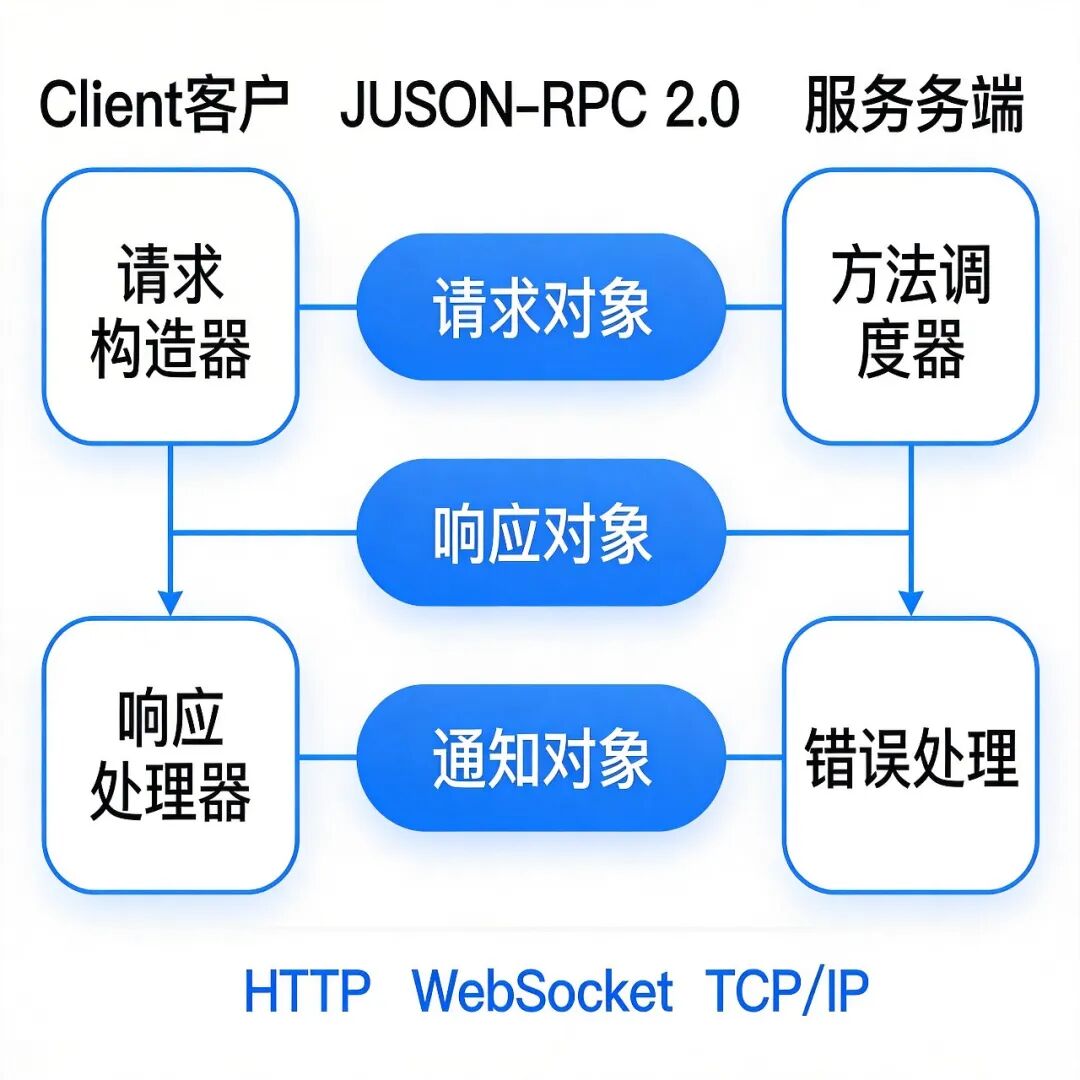

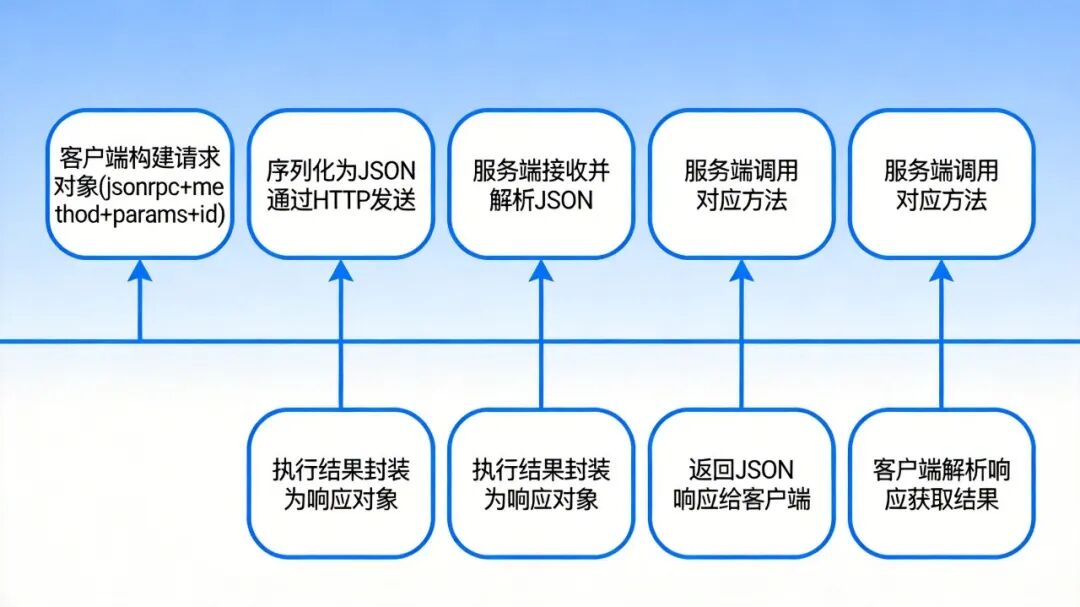

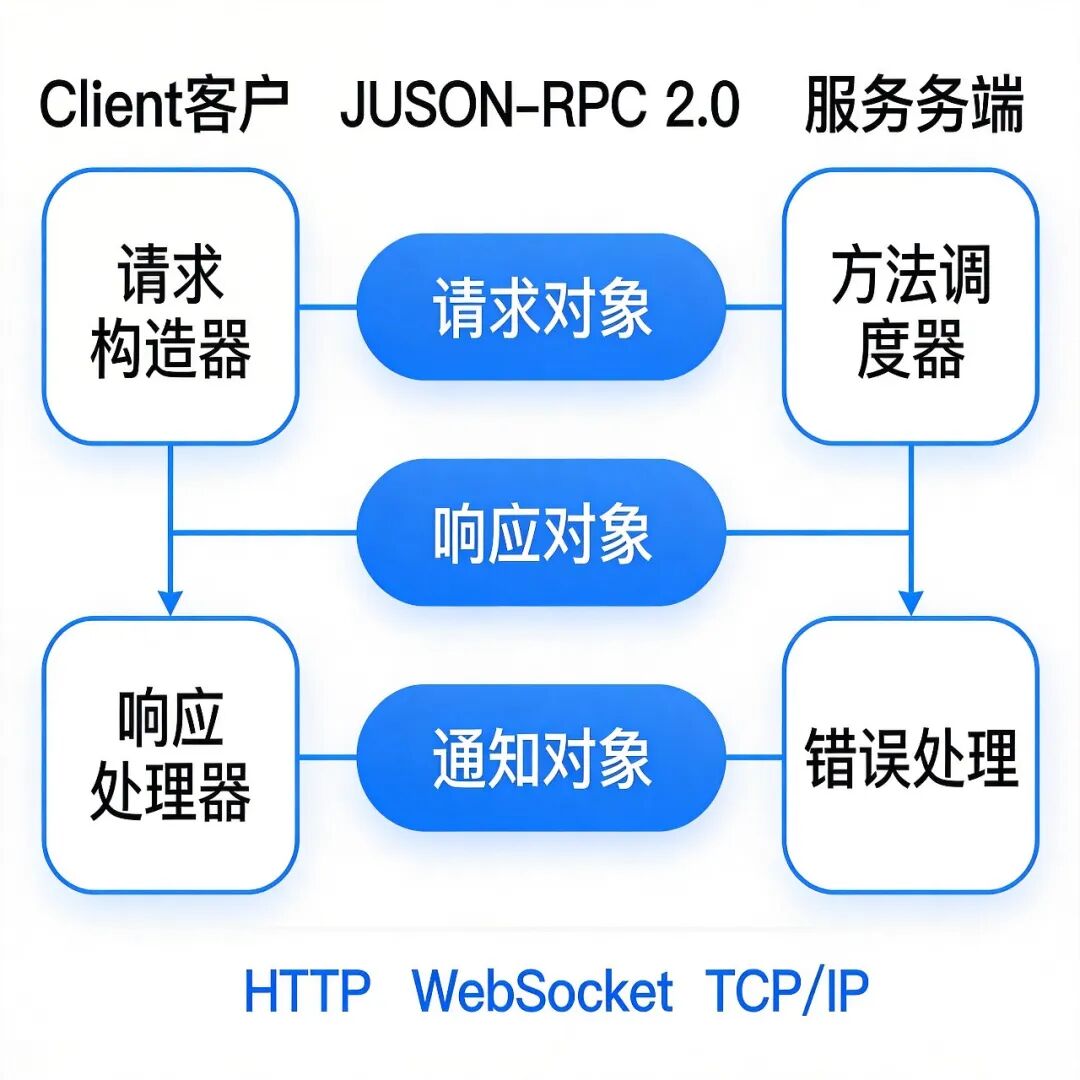

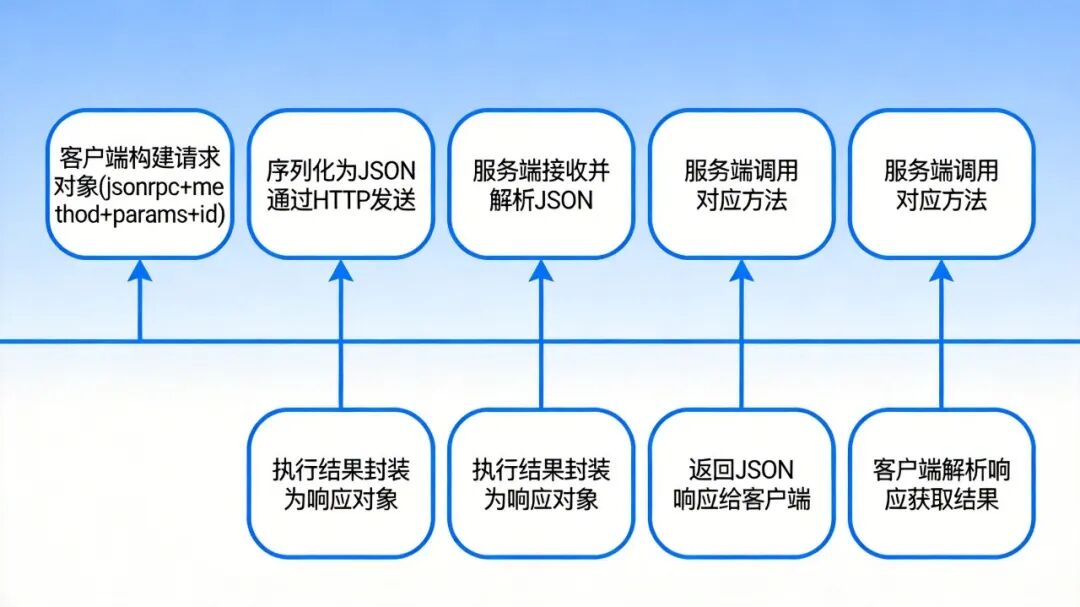

+JSON-RPC 2.0 定义了三种核心消息类型:**请求对象(Request Object)**、**响应对象(Response Object)** 和 **通知对象(Notification Object)**。

+

+

+

+### 请求对象结构

+

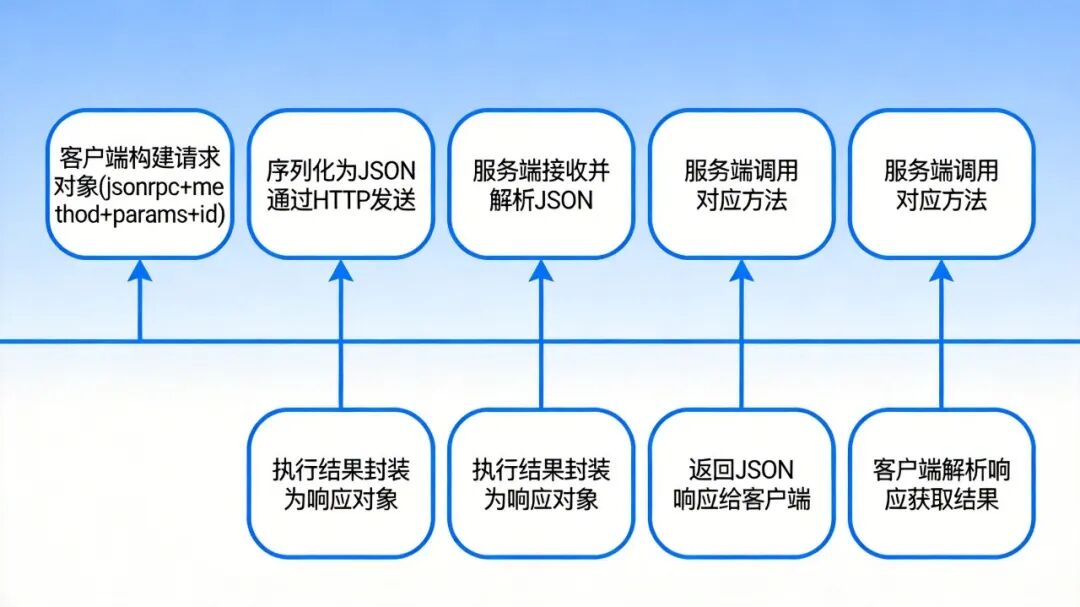

+请求对象是客户端向服务端发起 RPC 调用的载体:

+

+```json

+{

+ "jsonrpc": "2.0",

+ "method": "subtract",

+ "params": [42, 23],

+ "id": 1

+}

+```

+

+- **jsonrpc 字段**:协议版本标识,值必须是字符串 "2.0"。

+- **method 字段**:要调用的方法名称,区分大小写。以 "rpc." 开头的方法名预留给 JSON-RPC 内部扩展,如 `rpc.subscribe`、`rpc.notify`。

+- **params 字段**:方法参数,可以是数组(按顺序)或对象(按名称)。参数可选,不需要时可以省略。

+

+```json

+// 索引数组参数:参数顺序与服务端预期一致

+{"jsonrpc": "2.0", "method": "subtract", "params": [42, 23], "id": 1}

+

+// 命名对象参数:参数名需与服务端方法签名匹配

+{"jsonrpc": "2.0", "method": "subtract", "params": {"minuend": 42, "subtrahend": 23}, "id": 2}

+```

+

+- **id 字段**:客户端生成的唯一标识符,用于关联请求和响应。id 可以是字符串、数值或 null。建议避免使用 null,因为 JSON-RPC 1.0 的通知机制使用 null,可能引起混淆。使用数值作为 id 时,应避免小数。

+

+### 响应对象结构

+

+响应对象是服务端返回给客户端的执行结果:

+

+```json

+// 成功响应

+{

+ "jsonrpc": "2.0",

+ "result": 19,

+ "id": 1

+}

+

+// 错误响应

+{

+ "jsonrpc": "2.0",

+ "error": {

+ "code": -32601,

+ "message": "Method not found",

+ "data": "详细错误信息"

+ },

+ "id": 1

+}

+```

+

+响应对象必须包含 `result` 或 `error` 之一,不能同时包含两者。`id` 必须与对应请求中的 id 保持一致。

+

+如果请求本身存在错误(如无效的 JSON 格式或非法请求结构),导致服务端无法确定原始 id 时,响应中的 id 必须为 null。

+

+### 通知机制

+

+通知是一种不需要响应的请求,通过省略 `id` 字段来标识:

+

+```json

+{

+ "jsonrpc": "2.0",

+ "method": "update",

+ "params": [1, 2, 3, 4, 5]

+}

+```

+

+通知适用于日志记录、事件发布、进度通知等场景。客户端只负责发送消息,不需要处理响应。

+

+由于没有响应机制,客户端无法得知通知是否被成功处理。在批量请求中,通知请求不会产生对应的响应。

+

+

+

+## 错误处理机制

+

+### 错误对象结构

+

+JSON-RPC 2.0 定义了标准化的错误对象:

+

+```json

+{

+ "code": -32603,

+ "message": "Internal error",

+ "data": { "details": "数据库连接失败" }

+}

+```

+

+- **code 字段**:整数错误码,标识错误类型。

+- **message 字段**:简短的人类可读错误描述,通常是一句话。

+- **data 字段**:可选,携带错误的附加信息,可以是字符串、对象或任何有效的 JSON 值。

+

+### 预定义错误码

+

+JSON-RPC 2.0 在 -32768 到 -32000 范围内预留了预定义错误码:

+

+| 错误码 | 名称 | 说明 |

+|--------|------|------|

+| -32700 | Parse Error | 解析错误,服务端收到的 JSON 格式无效 |

+| -32600 | Invalid Request | 无效请求,发送的不是有效的请求对象 |

+| -32601 | Method Not Found | 方法不存在或不可调用 |

+| -32602 | Invalid Params | 参数无效 |

+| -32603 | Internal Error | JSON-RPC 内部错误 |

+

+

+

+-32000 到 -32099 范围内的错误码保留给服务端自定义使用。应用程序也可以定义自己的错误码(通常为负数且绝对值小于 32767)。

+

+### 错误处理建议

+

+- **合理使用 data 字段**:code 和 message 提供错误的基本分类,data 可以包含调试信息、堆栈跟踪或业务相关的详细信息。生产环境中注意控制敏感信息暴露。

+- **统一错误处理中间件**:在服务端统一拦截和处理错误,将业务异常转换为标准化的 JSON-RPC 错误格式,避免暴露内部实现细节。

+- **区分错误类型**:某些错误(如参数校验失败)是客户端问题,可以提示用户修正;另一些错误(如数据库故障)需要服务端介入处理。

+

+## 批量调用与性能优化

+

+### 批量请求机制

+

+JSON-RPC 2.0 支持在单个请求中发送多个 RPC 调用,服务端返回相应的响应数组。这一机制在高并发场景下可以减少网络往返次数。

+

+```json

+// 批量请求

+[

+ {"jsonrpc": "2.0", "method": "sum", "params": [1, 2, 4], "id": "1"},

+ {"jsonrpc": "2.0", "method": "notify_hello", "params": [7]},

+ {"jsonrpc": "2.0", "method": "subtract", "params": [42, 23], "id": "2"},

+ {"jsonrpc": "2.0", "method": "get_data", "id": "9"}

+]

+```

+

+对应的批量响应:

+

+```json

+[

+ {"jsonrpc": "2.0", "result": 7, "id": "1"},

+ {"jsonrpc": "2.0", "result": 19, "id": "2"},

+ {"jsonrpc": "2.0", "result": ["hello", 5], "id": "9"}

+]

+```

+

+通知请求(没有 id 字段)不会产生响应。响应数组中各元素的顺序与请求顺序无关,客户端通过匹配 id 来关联请求和响应。

+

+### 批量调用的边界情况

+

+规范对批量调用中的边界情况有明确定义:

+

+如果批量请求本身不是有效的 JSON 或不是包含至少一个值的数组,服务端应返回单对象响应而非数组。空数组 `[]` 被视为无效请求。

+

+如果批量请求中的所有请求都是通知,服务端不需要返回任何响应。其他情况下,即使某些请求处理失败,响应数组中仍应包含对应请求的错误响应。

+

+### 性能优化策略

+

+- **连接复用**:使用持久化连接(如 HTTP Keep-Alive 或 WebSocket)可以避免频繁建立和销毁连接的开销。

+- **批量聚合**:将多个相关的小请求合并为一个批量请求,减少网络往返次数。

+- **压缩传输**:启用 HTTP 压缩(如 gzip)可以减少大型 JSON 响应体的传输体积。

+- **异步处理**:使用异步调用和通知机制,提高客户端的并发处理能力。

+

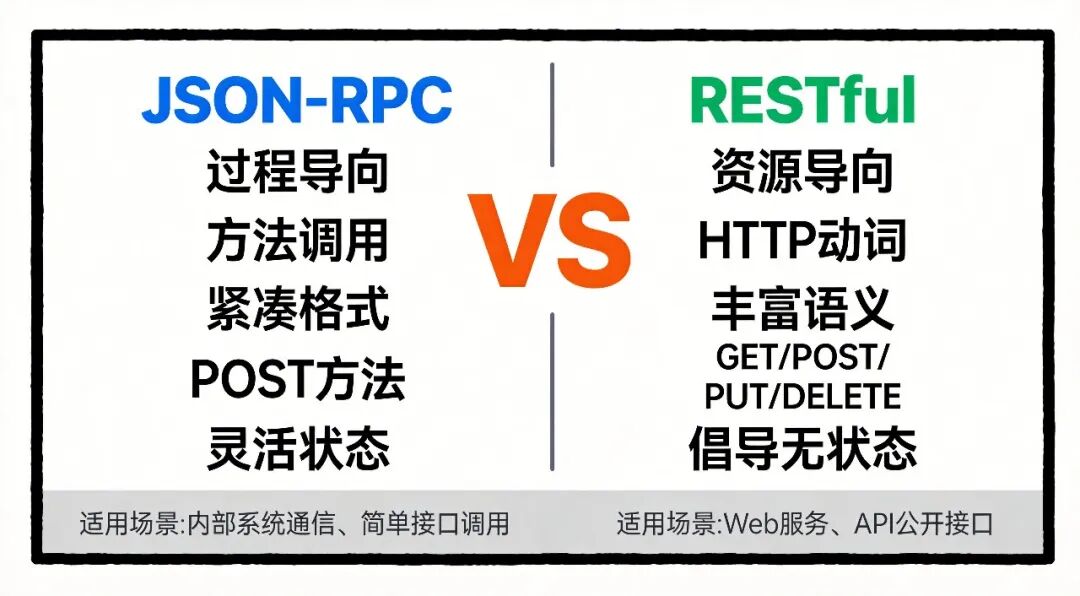

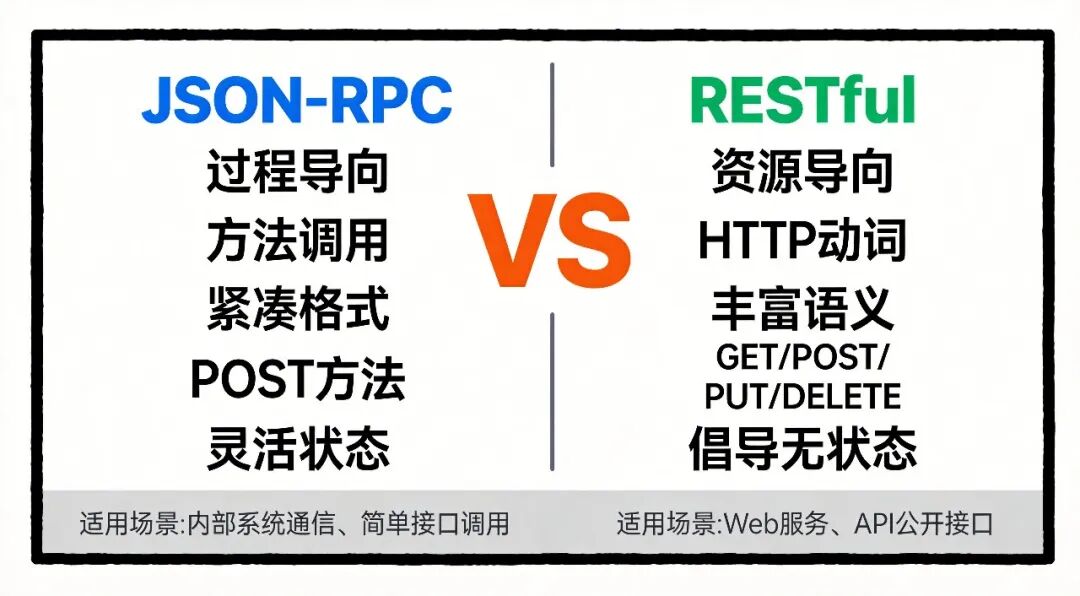

+## 与 RESTful API 的对比分析

+

+### 设计理念差异

+

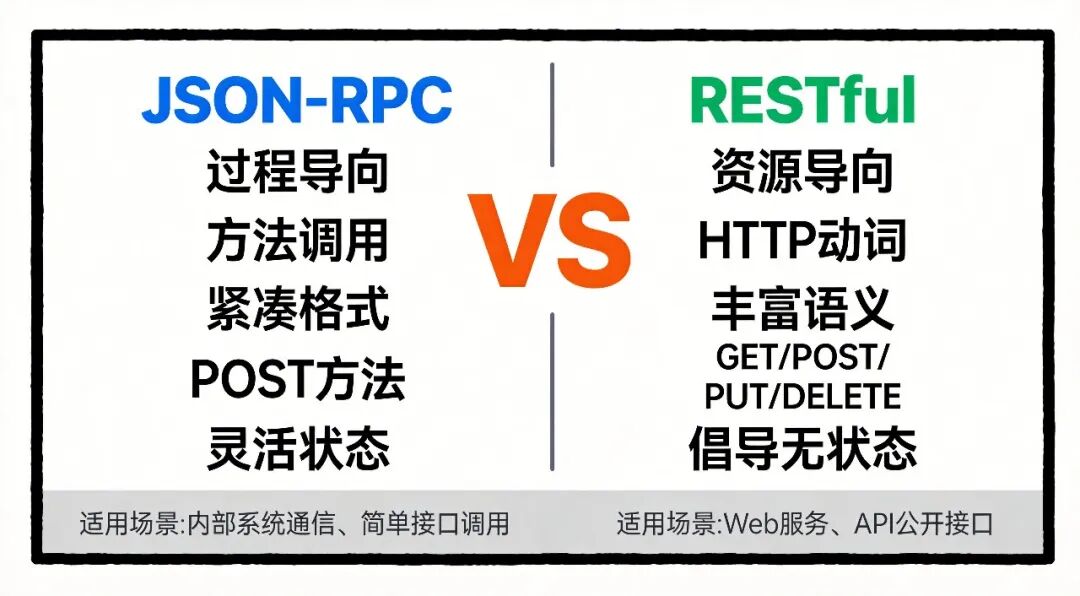

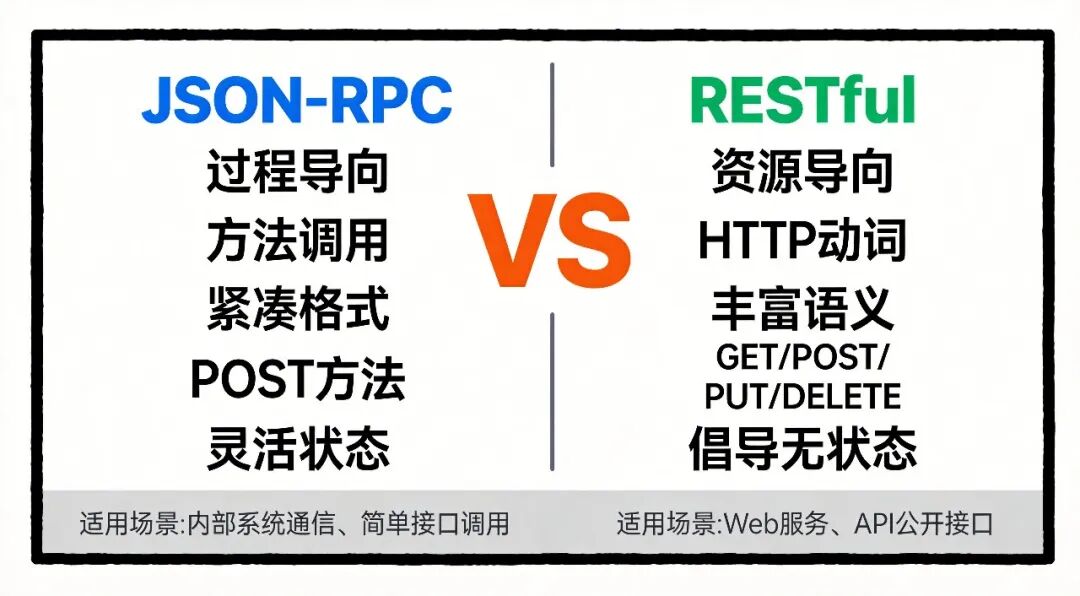

+JSON-RPC 和 RESTful 代表了两种不同的 API 设计哲学。JSON-RPC 是过程导向的,关注的是"做什么操作";RESTful 是资源导向的,关注的是"操作什么资源"。

+

+以用户操作为例:

+

+```json

+// JSON-RPC: 直接调用方法

+{"jsonrpc": "2.0", "method": "createUser", "params": {"name": "张三", "email": "zhang@example.com"}, "id": 1}

+

+// RESTful: 操作资源

+POST /users

+{"name": "张三", "email": "zhang@example.com"}

+```

+

+### 通信模式对比

+

+| 维度 | JSON-RPC | RESTful |

+|------|----------|---------|

+| 语义抽象 | 方法调用 | 资源操作 |

+| URL 角色 | 仅作为端点地址 | 表示资源路径 |

+| HTTP 方法 | 仅使用 POST | 充分利用 GET/POST/PUT/DELETE |

+| 状态管理 | 可维护会话状态 | 倡导无状态设计 |

+| 灵活性 | 更紧凑,适合精确控制 | 更灵活,适合通用场景 |

+

+

+

+### 选型建议

+

+**适合使用 JSON-RPC 的场景**:

+

+- 内部服务间通信,接口相对稳定

+- 需要精确的方法语义和参数控制

+- 对带宽敏感,需要紧凑的消息格式

+- 团队对 RPC 模式更熟悉

+

+**适合使用 RESTful 的场景**:

+

+- 公开 API,需要良好的可发现性

+- 资源概念明确的 CRUD 操作

+- 需要利用 HTTP 缓存机制

+- 追求 API 的自我描述能力

+

+## 安全性考量

+

+### 常见安全威胁

+

+JSON-RPC 的简洁设计虽然降低了实现复杂度,但也带来了一些安全考量:

+

+- **数据泄露**:JSON-RPC 通常通过 HTTP 传输,未加密的通信可能被中间人攻击截获。

+- **方法枚举**:如果服务端没有正确限制可调用方法,攻击者可能通过枚举方法名发现未公开的接口。

+- **拒绝服务**:恶意客户端可能发送大量请求或构造超大的批量请求,耗尽服务端资源。

+- **注入攻击**:不安全的参数处理可能导致 SQL 注入、命令注入等安全漏洞。

+- **重放攻击**:截获的有效请求可能被攻击者重放,造成非预期的重复操作。

+

+

+

+### 安全加固措施

+

+- **传输层加密**:使用 HTTPS 协议,确保通信内容的机密性和完整性。

+- **身份认证与授权**:实现身份验证机制(如 JWT、OAuth 2.0),在方法层面实施细粒度的授权控制。

+- **输入验证**:对所有参数进行严格的类型检查和值域验证。

+- **速率限制**:实施请求速率限制,防止恶意高频访问。

+- **方法白名单**:仅暴露必要的方法,对未公开的方法返回 -32601 错误。

+- **日志与监控**:记录详细的请求日志,监控异常模式,及时发现潜在攻击。

+

+## 结语

+

+JSON-RPC 2.0 协议设计简洁,在分布式系统通信中有其适用场景。规范本身很短,学习和实现成本都不高,JSON 格式的请求/响应便于调试和日志记录。

+

+当然,JSON-RPC 也有局限性。它缺少内置的元数据机制,类型系统相对简单。在需要高度标准化、复杂类型系统或强类型安全的场景中,可以考虑 gRPC、Thrift 等方案。

+

+如果你的业务场景需要简单、透明的服务间通信方式,JSON-RPC 是一个值得考虑的选择。

diff --git "a/docs/md/AI/RAG\350\257\246\350\247\243\357\274\232\350\256\251\345\244\247\346\250\241\345\236\213\347\234\213\350\247\201\344\275\240\347\232\204\347\247\201\346\234\211\347\237\245\350\257\206.md" "b/docs/md/AI/RAG\350\257\246\350\247\243\357\274\232\350\256\251\345\244\247\346\250\241\345\236\213\347\234\213\350\247\201\344\275\240\347\232\204\347\247\201\346\234\211\347\237\245\350\257\206.md"

new file mode 100644

index 0000000..2204101

--- /dev/null

+++ "b/docs/md/AI/RAG\350\257\246\350\247\243\357\274\232\350\256\251\345\244\247\346\250\241\345\236\213\347\234\213\350\247\201\344\275\240\347\232\204\347\247\201\346\234\211\347\237\245\350\257\206.md"

@@ -0,0 +1,223 @@

+在把大语言模型用到实际业务时,开发者很快会遇到一个问题:通用模型很难满足特定场景的需求。

+

+主要卡在三个地方:

+

+- **知识过时**:模型的训练数据有截止日期,问它最近发生的事基本白问。

+

+- **幻觉严重**:模型经常一本正经地胡说八道,在需要准确性的场景这是致命的。

+

+- **数据安全**:企业不可能把内部文档上传给第三方,但不上传模型又不会。

+

+

+

+基于这个问题,**RAG(检索增强生成)** 出现了。它的思路很简单:不把数据交给模型,而是让模型"看到"它需要的部分。

+

+用户提问时,系统从私有知识库中检索相关片段,把这些片段和问题一起发给大模型。模型结合真实信息来回答,而不是靠"记忆"里不知道哪来的东西生成。

+

+## 为什么需要 RAG

+

+### 知识的局限性

+

+大语言模型的知识完全来自训练数据。GPT-4、文心一言、通义千问这些主流模型,训练数据主要来自网络公开数据。这带来两个问题:

+

+- **时效性**:模型的"知识"被定格在训练截止时间点。GPT-4 的知识库可能停在 2023 年 12 月,之后的新事件、新政策、新技术,它无法直接给出准确答案。

+- **私有领域缺失**:企业的产品规格文档、内部流程规范、医疗机构的诊断指南、法律机构的判例汇编——这些数据从没出现在公开网络上,通用大模型对此一无所知。不借助外部手段,模型在这些领域的回答质量会大打折扣。

+

+### 幻觉问题

+

+大语言模型在生成文本时,实际上是在计算下一个 token 出现的概率分布。这种机制导致模型在面对不确定性问题时,经常编造看似合理实则错误的答案——学名叫"幻觉"(Hallucination)。

+

+更麻烦的是,模型不具备某一方面知识时,它不会选择"不知道",而是倾向于根据训练数据中学习到的语言模式,自信满满地瞎编。在需要高度准确性的生产环境中,这绝对不可接受。

+

+### 数据安全

+

+对企业来说,数据安全是生死攸关的议题。没人愿意承担核心商业机密泄露的风险,因此几乎没有企业愿意将私有数据上传到第三方平台进行模型训练或推理。

+

+这意味着,完全依赖通用大模型自身能力的应用方案,不得不在**数据安全**和**应用效果**之间做取舍。传统方案要么保数据安全牺牲模型能力,要么提升模型能力却承担数据泄露风险。

+

+## RAG 的破局思路

+

+RAG 提供了第三条路:不把数据交给模型,而是让模型"看到"它需要的那部分数据。

+

+用户提问时,系统从私有知识库中检索相关片段,把这些片段作为上下文提供给大模型。大模型在回答时,既能"参考"检索到的真实信息,又能结合自身的语言理解能力生成流畅的回答。数据始终留在本地,模型获得了"感知"私有知识的能力。

+

+## RAG 的技术架构

+

+RAG 的完整工作流程分为两个阶段:**数据准备阶段(离线索引)** 和 **应用阶段(在线推理)**。

+

+

+

+### 数据准备阶段:构建知识的向量化索引

+

+数据准备是离线过程,目标是将私有数据转化为可高效检索的向量形式。流程包含四个环节:

+

+**数据提取**。从多种格式的原始文件中提取纯文本内容,包括 PDF、Word、HTML、数据库记录等。技术挑战在于处理各种格式解析、特殊字符清理、无用内容过滤。常用 LangChain 的 DocumentLoaders 来统一处理不同来源的数据。

+

+**文本分割(Chunking)**。直接影响检索质量。需要综合考虑两个因素:一是 embedding 模型对 token 长度的限制;二是语义完整性对检索效果的影响。

+

+固定长度分割实现简单,但容易切断语义边界,导致检索时丢失关键上下文。语义分割通过识别句子边界或段落结构来进行切分,能更好地保留语义完整性,但实现复杂度更高。业界常用策略是设置合适的 chunk size(如 512 tokens)和 overlap(如 50-100 tokens),在保证语义完整性的同时避免边界效应。

+

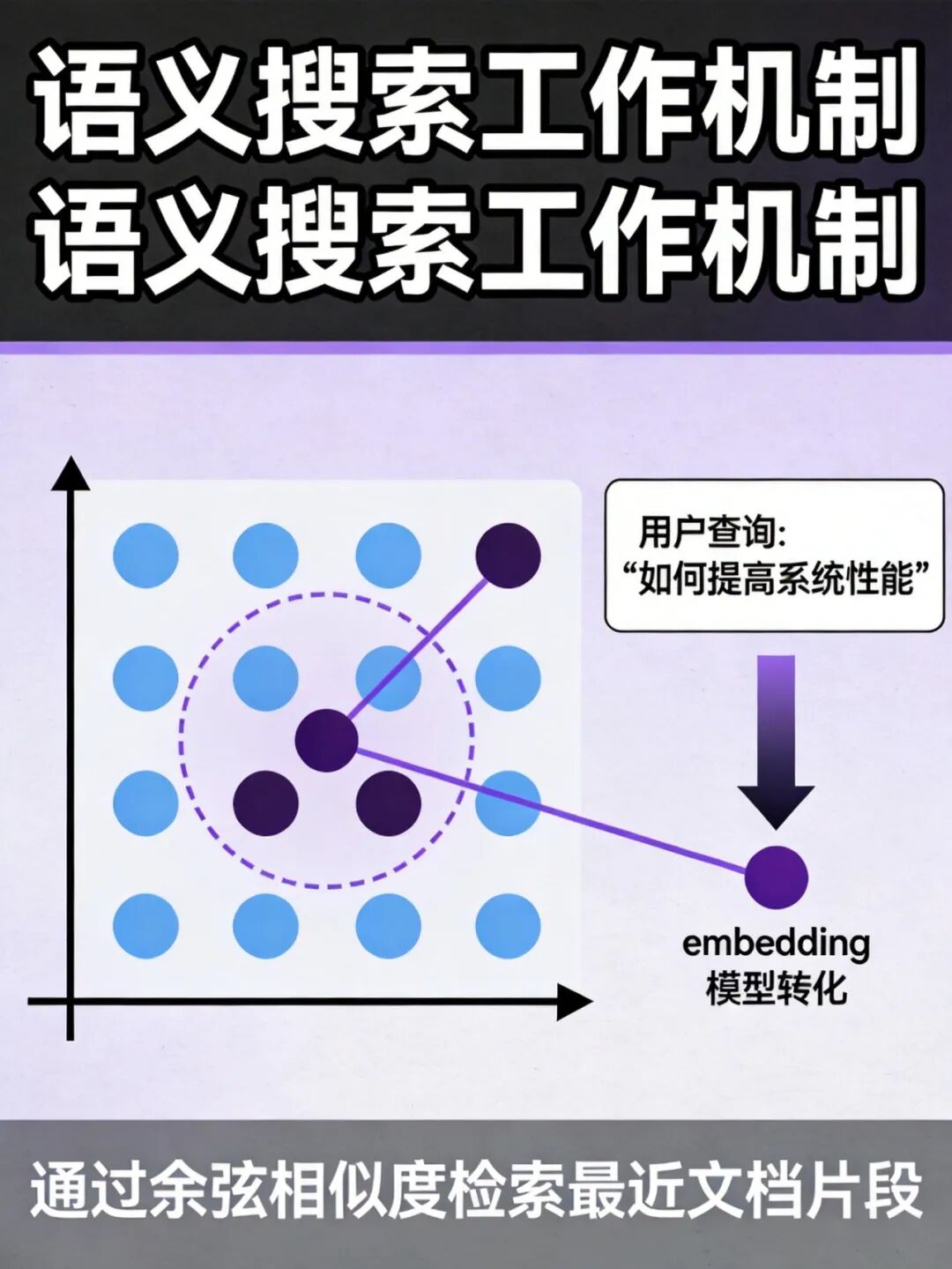

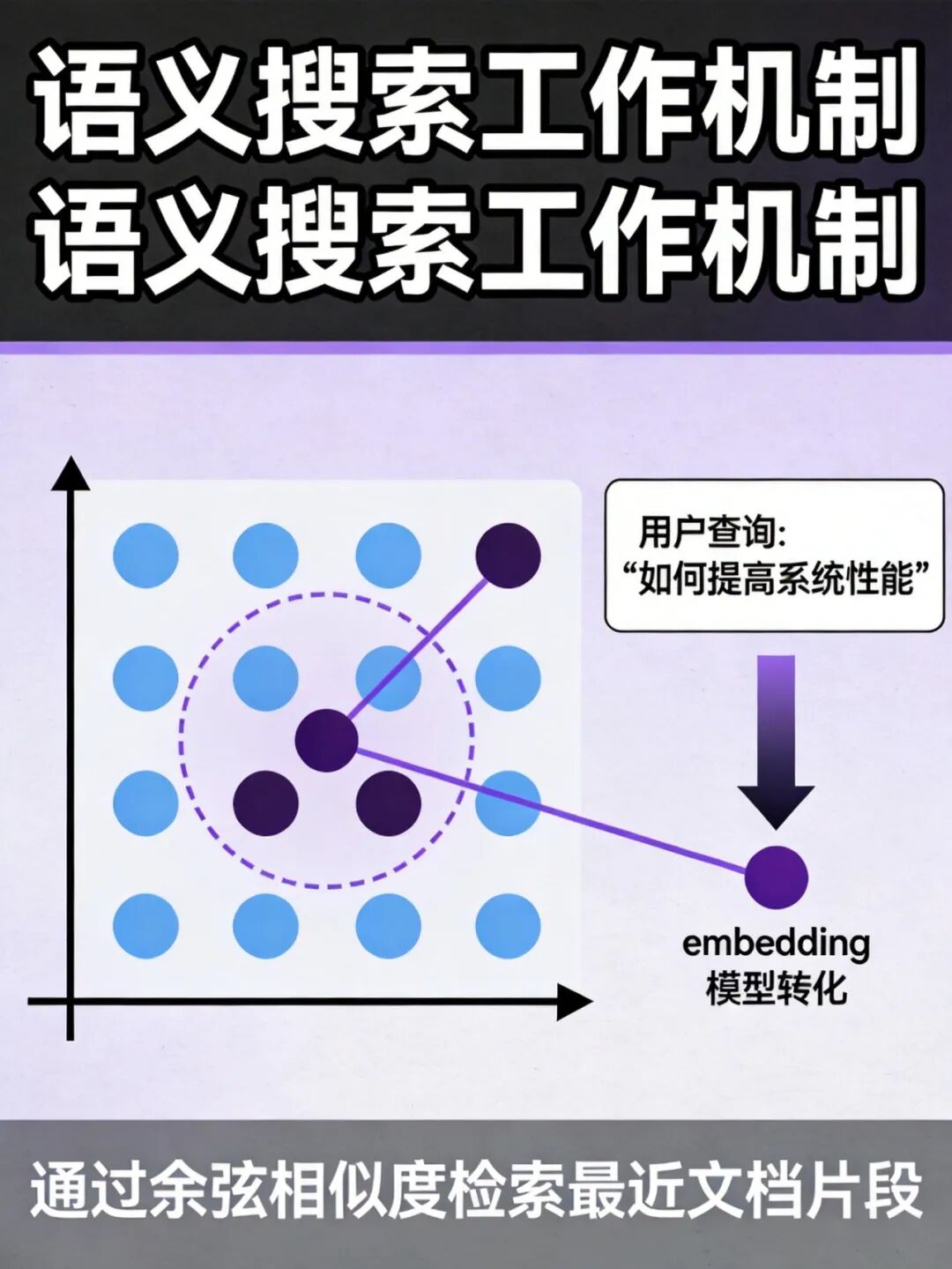

+**向量化(Embedding)**。将文本转化为高维向量,让语义相似的文本在向量空间中具有相近的位置关系。常见的 embedding 模型:

+

+| 模型名称 | 特点 | 适用场景 |

+|---------|------|---------|

+| OpenAI text-embedding-3 | API 调用,稳定可靠 | 通用场景 |

+| BGE (BAAI) | 开源、支持中英文 | 自部署场景 |

+| M3E (MokaAI) | 开源、多语言支持 | 中文场景 |

+| ERNIE-Embedding | 百度自研、中文优化 | 国产化需求 |

+

+**数据入库**。将向量及其关联的原始文本、元数据写入向量数据库。主流选择包括 FAISS、Chroma、Milvus、Weaviate 和 Qdrant 等。这些数据库采用近似最近邻(ANN)算法,能够在海量向量中快速找到与查询向量最相似的结果。

+

+### 应用阶段

+

+

+

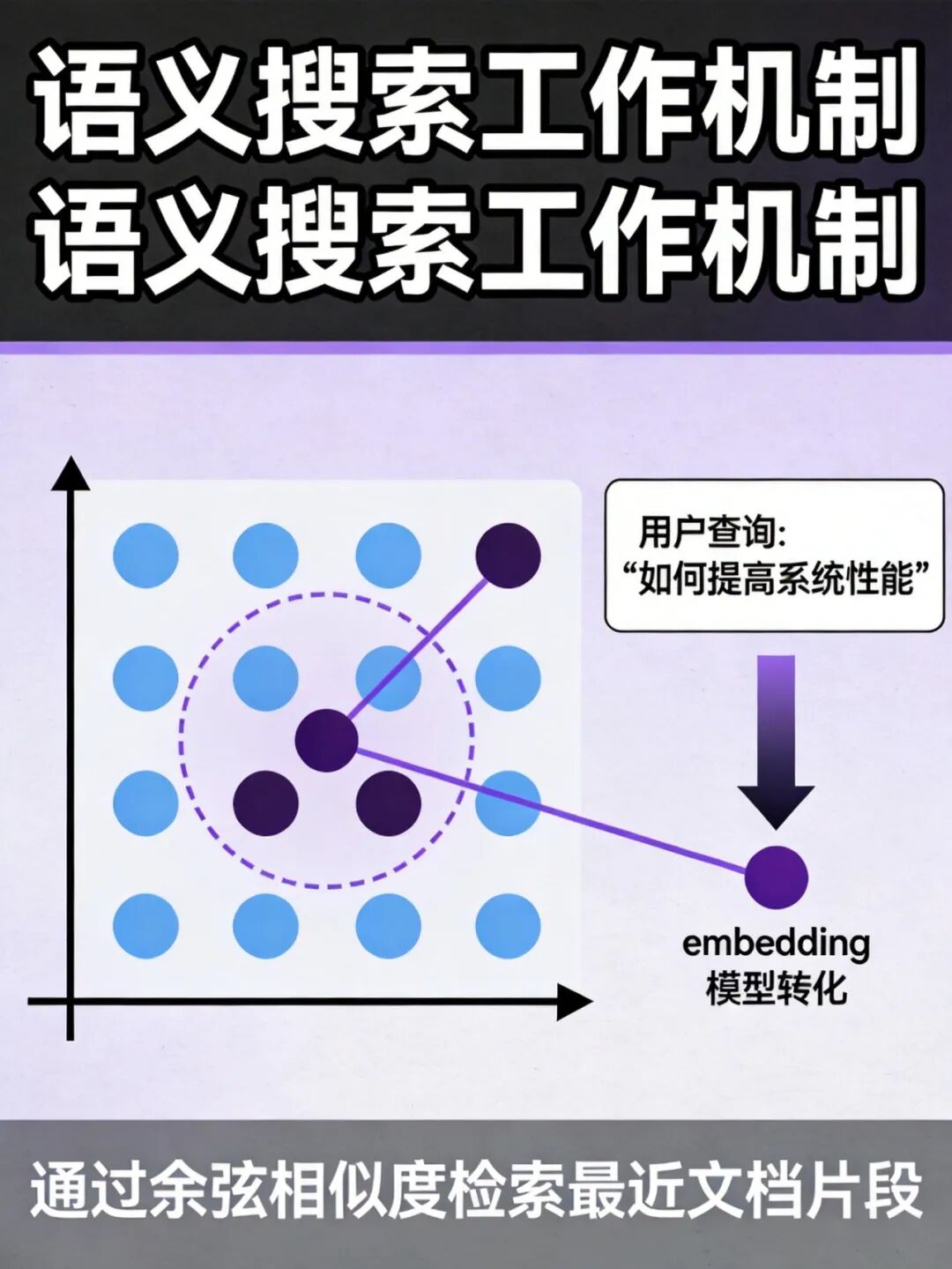

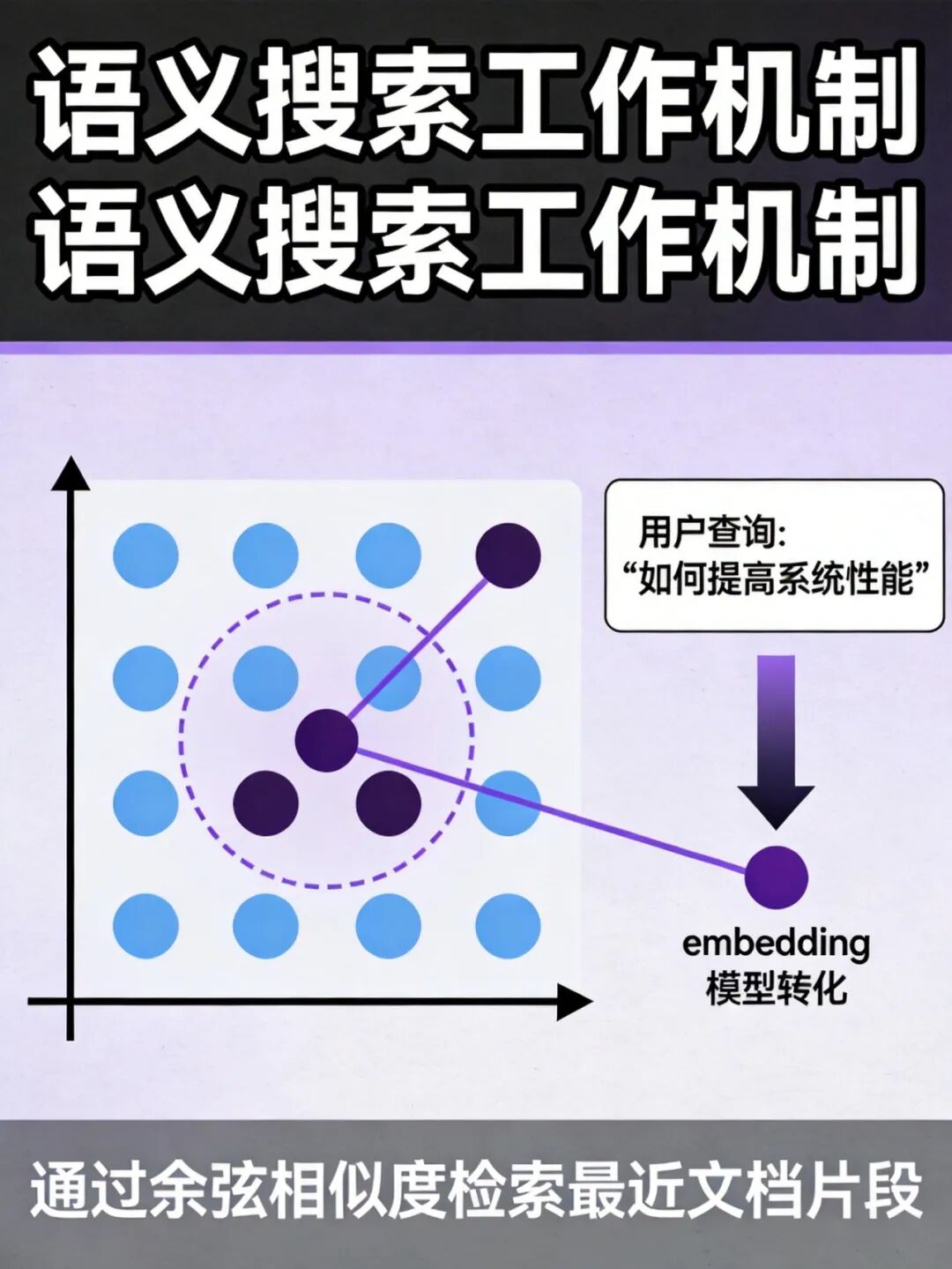

+用户提出问题时,RAG 系统进入在线推理阶段,包含四个关键步骤:

+

+**查询向量化**。使用与索引阶段相同的 embedding 模型,将用户的自然语言问题转化为语义向量。这个向量的质量直接决定后续检索的准确性。

+

+**信息检索(Retrieval)**。通过计算查询向量与所有存储向量的相似度(如余弦相似度、欧氏距离),找出 top-k 个最相关的文档片段。现代向量数据库通常采用 HNSW(Hierarchical Navigable Small World)等算法,在保证检索精度的同时实现毫秒级响应。

+

+**上下文构建**。将检索到的相关片段与原始问题组装成完整的提示模板。一个典型的 RAG 提示模板:

+

+```

+【任务描述】

+假如你是一个专业的客服机器人,请参考【背景知识】中的内容,准确回答用户的问题。

+

+【背景知识】

+{检索到的相关文档片段}

+

+【用户问题】

+{用户原始问题}

+

+【回答要求】

+- 仅根据【背景知识】中的内容回答

+- 如果【背景知识】中没有相关信息,请明确告知

+- 回答要简洁、准确、有条理

+```

+

+**答案生成(Generation)**。大语言模型接收包含问题和上下文的提示后,结合检索到的真实信息生成最终答案。由于有明确的参考资料作为约束,模型产生幻觉的概率大大降低。

+

+## 高级 RAG 技术

+

+基础 RAG 流程能工作,但在实际应用中往往面临检索质量不足、生成效果不稳定等问题。业界发展出一系列高级 RAG 技术来优化系统性能。

+

+

+

+### 搜索索引的演进

+

+**平面索引(Flat Index)** 直接计算查询向量与所有存储向量的相似度。实现简单,但数据规模达到数万条时,线性扫描的计算开销变得不可接受。

+

+**向量索引** 采用近似最近邻算法来解决效率问题。FAISS 库提供了多种索引类型:

+

+- **IVF(Inverted File Index)**:通过聚类将向量分组,检索时只搜索最相关的聚类中心,显著减少计算量。

+- **HNSW(Hierarchical Navigable Small World)**:构建多层图结构,实现对数级别的检索复杂度。

+- **PQ(Product Quantization)**:对高维向量进行压缩,大幅降低内存占用。

+

+**分层索引** 应对大型知识库。系统维护两个层级的索引:一个由文档摘要组成,用于快速过滤;另一个由文档块组成,用于精确检索。这种设计在保证检索召回率的同时,大幅提升检索效率。

+

+### 混合搜索

+

+单纯的向量检索在处理精确术语匹配时往往表现不佳。比如用户搜索"如何重置密码",向量检索可能无法准确识别"重置"和"修改"之间的细微差别。

+

+**混合搜索** 结合传统关键词检索(如 BM25、TF-IDF)和现代语义向量检索。两种检索结果通过 **Reciprocal Rank Fusion(RRF)算法** 进行融合:对不同检索方法的结果按排名赋分,综合排名最高的文档被选中。

+

+关键词检索确保精确匹配的召回,语义检索捕捉同义词和语义关联。两者互补,能够应对更广泛的查询类型。

+

+### 内容增强

+

+**语句窗口检索器(Sentence Window Retriever)** 采用"小块索引、大窗口上下文"的策略。文档中的每个句子单独嵌入向量索引以保证检索精度,但检索后扩展上下文窗口,额外获取前后各 k 个句子,提供更完整的语义信息给大模型。

+

+**自动合并检索器(Parent Document Retriever)** 采用层级分割策略:文档被递归分割为较小的子块,每个子块与较大的父块存在引用关系。检索时获取相关子块,当多个相关子块指向同一父块时,自动升级为使用父块作为上下文。这种设计让系统同时获得精确检索和宏观语义。

+

+### HyDE:假设性答案增强检索

+

+**HyDE(Hypothetical Document Embeddings)** 是一种逆向思维的方法:不直接用问题检索,而是先用大模型根据问题生成一个假设性的答案,然后用这个假设答案去检索相关文档。

+

+前提假设是:假设答案与真实文档在语义空间中可能更接近,因为两者都是"回答性"的文本。HyDE 在处理抽象概念或模糊查询时表现尤为出色。

+

+### 查询转换

+

+用户的原始问题往往不够"检索友好"。**查询转换** 系列技术利用大模型的推理能力来优化查询:

+

+**查询分解(Query Decomposition)** 将复杂问题拆分为多个简单子问题。例如,"LangChain 和 LlamaIndex 哪个更适合做 RAG 开发?"这个问题难以直接检索,但可以拆分为"LangChain 做 RAG 开发的优缺点"和"LlamaIndex 做 RAG 开发的优缺点"两个子问题,分别检索后再综合回答。

+

+**Step-back Prompting** 生成更通用的查询来获取高层次上下文,与原始查询的检索结果一起输入模型,实现"由面到点"的推理。

+

+**查询重写(Query Rewriting)** 使用大模型改写问题表达,尝试用不同的表述方式检索,提高召回率。

+

+### 重排与过滤

+

+检索返回的 top-k 结果可能存在质量问题:相关性参差不齐、信息冗余、噪声干扰。**重排(Reranking)** 技术应运而生。

+

+**交叉编码器重排** 将查询和每个候选文档一起输入专门的交叉编码模型,输出精细化的相关性评分。这种方法比向量相似度计算更准确,但计算开销更大,通常用于对初始检索结果的二次筛选。

+

+**基于元数据的过滤** 利用文档的元数据(时间、来源、类别等)进行条件筛选,快速排除不相关的结果。

+

+## RAG 融合

+

+**RAG 融合(RAG Fusion)** 通过 LLM 生成多个变体查询来增强检索效果。单一查询可能无法覆盖用户问题的所有方面,通过让 LLM 生成多个不同角度的查询,可以从知识库中召回更丰富、更多样化的相关信息。

+

+

+

+### 技术流程

+

+1. **多查询生成**:使用 LLM 根据用户原始问题生成 n 个相关查询。

+2. **并行向量搜索**:用所有生成的查询分别进行向量检索。

+3. **结果融合排序**:应用 RRF 算法对所有检索结果进行综合排名。

+4. **上下文注入**:将融合后的相关文档注入提示模板。

+5. **答案生成**:LLM 基于融合后的上下文生成最终答案。

+

+### 优势

+

+**多样性增强**:不同查询从不同角度切入问题,最终结果涵盖更广泛的视角,减少单一视角带来的偏差。

+

+**鲁棒性提升**:某个查询因表述偏差导致检索不佳时,其他查询可以弥补缺陷,提升整体系统的稳定性。

+

+**语义纠偏**:LLM 生成的查询往往是对原始问题的语义扩展,能够捕捉隐含的语义关联。

+

+### 注意事项

+

+**延迟增加**:额外的 LLM 调用会引入额外延迟,在延迟敏感的场景中需要权衡。

+

+**专业术语处理**:如果知识库包含大量内部术语或行话,LLM 可能因不了解这些术语而产生无关查询,此时需要针对性优化提示词。

+

+**成本考量**:额外的 LLM 调用意味着额外的 token 消耗,需要评估 ROI。

+

+## 评估体系

+

+RAG 系统的质量评估是工程实践中的重要环节。业界通常采用 **RAG 三元组** 评估框架:

+

+- 检索内容相关性(Context Relevance):评估检索到的文档与用户问题的相关程度。高相关性意味着检索阶段工作良好,能够召回真正有用的信息。常用指标包括召回率(Recall)和精确率(Precision)。

+- 答案基于性(Answer Groundedness):衡量 LLM 的回答是否基于检索到的上下文,而非依赖自身知识或产生幻觉。这一指标直接反映 RAG 机制的有效性。

+- 答案相关性(Answer Relevance):评估生成的回答是否有效解决了用户的问题。高相关性意味着即使检索和基于性都良好,最终答案也能真正满足用户需求。

+

+

+

+### 评估框架与工具

+

+**RAGAs** 是当前流行的 RAG 评估框架,提供标准化的评估流程和指标计算方法。

+

+**LangSmith** 是 LangChain 官方提供的评估平台,支持自定义评估器、运行时监控和调试追踪。

+

+**Truelens** 由 LlamaIndex 团队推出,专注于 RAG 系统的可观测性和评估。

+

+## 发展趋势

+

+RAG 技术正在快速演进,几个方向值得关注:

+

+**端到端优化**。传统 RAG 将检索和生成视为独立环节,但最新研究开始探索联合优化的可能性。Meta AI 提出的 **RA-DIT** 技术同时微调 LLM 和 Retriever,让两个组件在学习过程中相互适应,在知识密集型任务上取得了显著提升。

+

+**多模态 RAG**。随着多模态大模型的发展,RAG 的边界正在从纯文本扩展到图像、视频、音频等多种模态。未来的 RAG 系统需要能够处理跨模态的知识检索和生成。

+

+**主动学习与持续优化**。结合用户反馈和评估结果,构建自适应优化机制,让 RAG 系统能够从实际使用中持续学习和改进。

+

+**轻量化与边缘部署**。随着模型压缩技术的发展,更小、更快的 LLM 将成为 RAG 系统的新选择。Mistral Mixtral、Microsoft Phi-2 等小参数模型的崛起,为 RAG 在边缘设备上的部署开辟了新的可能性。

+

+## 结语

+

+RAG 技术通过将检索能力与大语言模型的生成能力相结合,为 LLM 的实际应用提供了一条切实可行的路。它解决了知识时效性、私有数据访问和幻觉抑制等核心问题。

+

+当然,RAG 不是万能药。检索质量、响应延迟、系统复杂度等挑战依然存在。开发者需要根据具体场景权衡利弊,选择合适的技术组合。

+

+至于未来会怎样,让时间来检验。

diff --git "a/docs/md/AI/ReAct\357\274\232\350\256\251\345\244\247\346\250\241\345\236\213\345\255\246\344\274\232\350\276\271\346\203\263\350\276\271\345\201\232.md" "b/docs/md/AI/ReAct\357\274\232\350\256\251\345\244\247\346\250\241\345\236\213\345\255\246\344\274\232\350\276\271\346\203\263\350\276\271\345\201\232.md"

new file mode 100644

index 0000000..d43addd

--- /dev/null

+++ "b/docs/md/AI/ReAct\357\274\232\350\256\251\345\244\247\346\250\241\345\236\213\345\255\246\344\274\232\350\276\271\346\203\263\350\276\271\345\201\232.md"

@@ -0,0 +1,286 @@

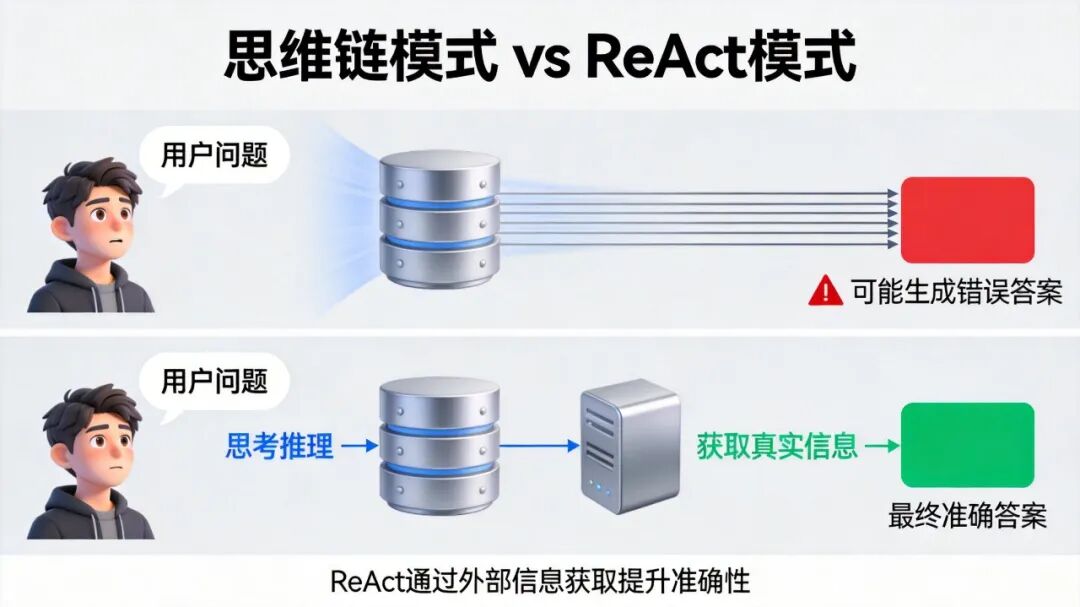

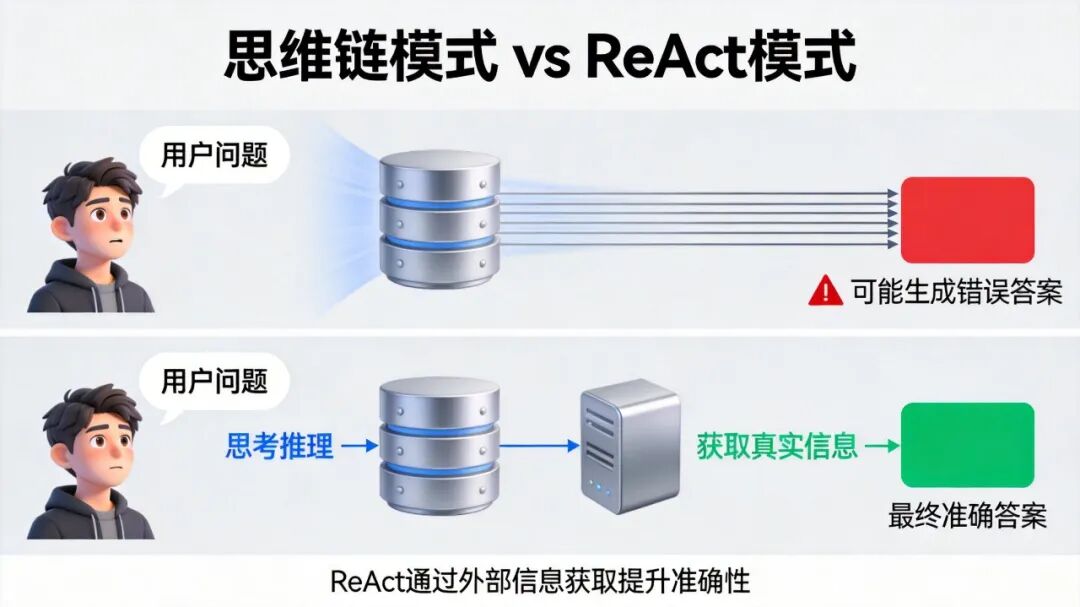

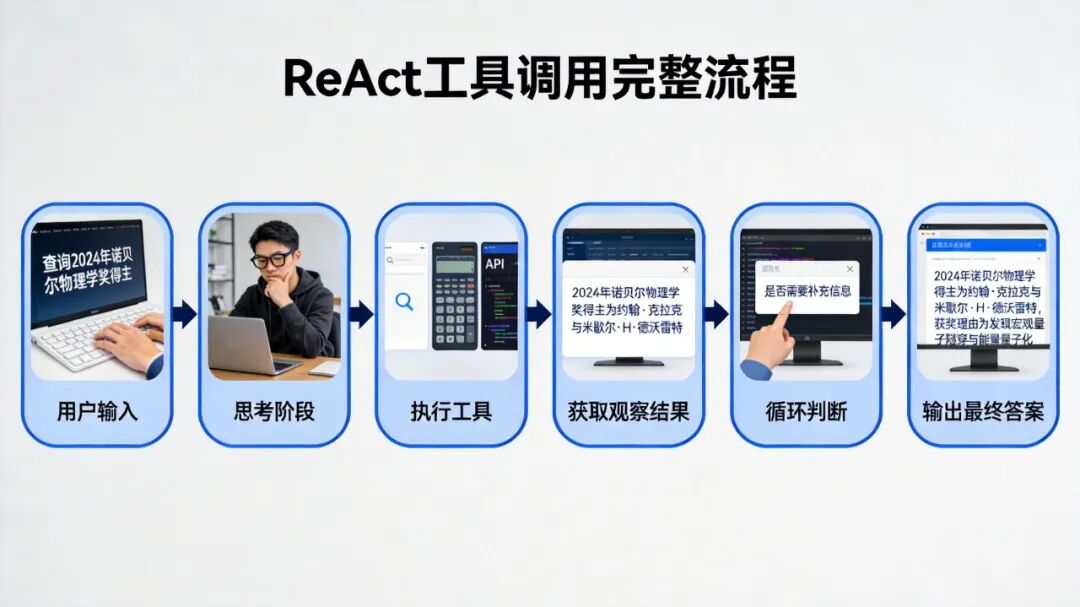

+传统聊天机器人相信大家都用过——你问一句,它答一句。线性,简单,但遇到复杂问题就露馅了。比如问"特斯拉股价相比去年涨了多少",它要么瞎编,要么说"我无法获取实时信息"。

+

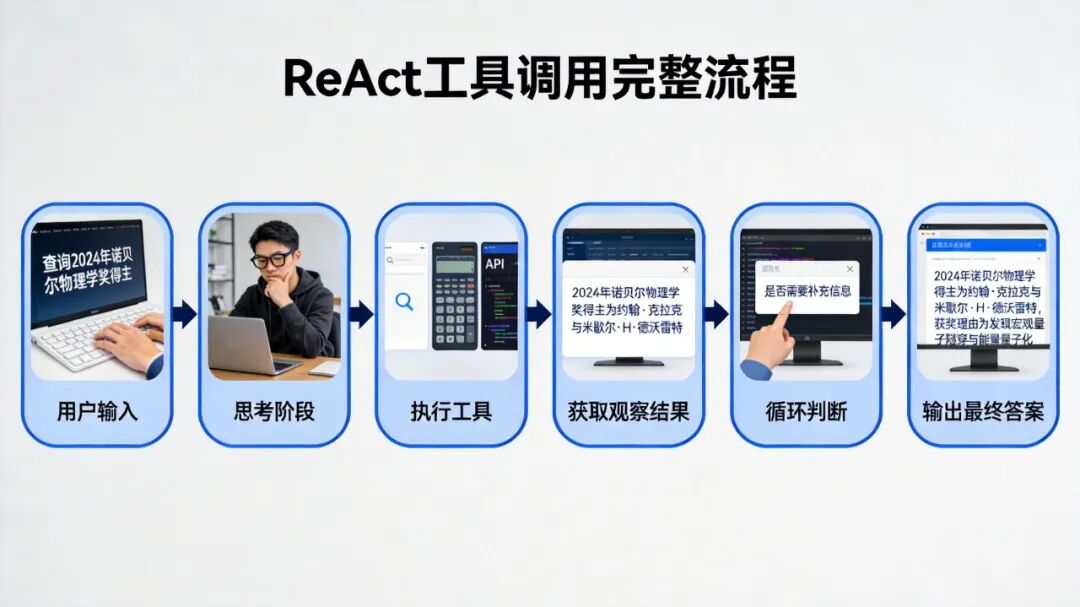

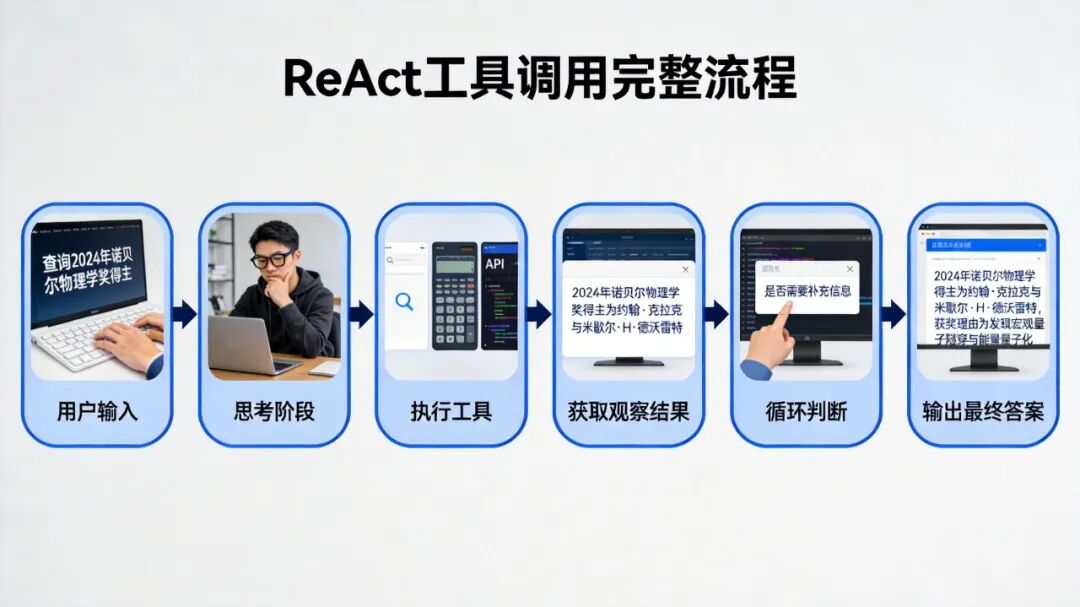

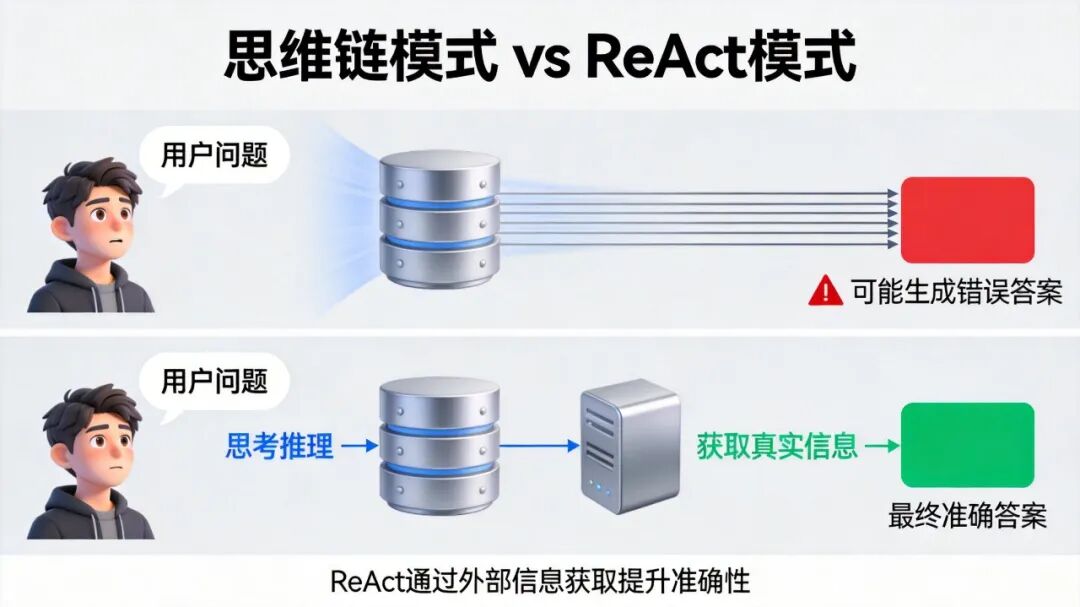

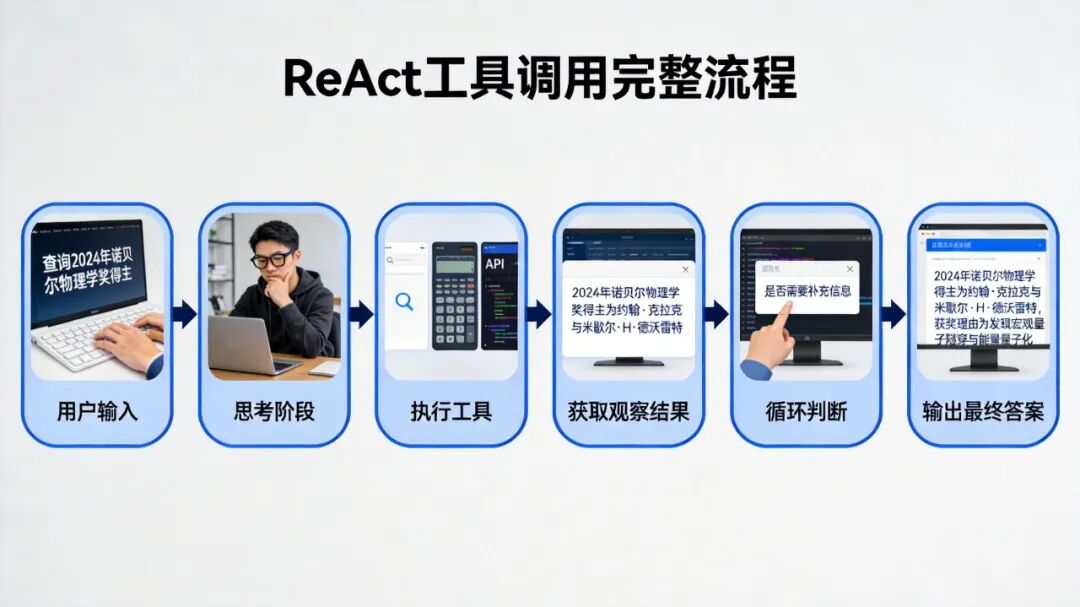

+2022年,Google Research提出了ReAct框架。它要解决的就是这个问题:**让大模型像人一样,一边想一边做,做完再看结果,接着想下一步**。

+

+## ReAct的核心原理

+

+### 先看个例子

+

+想象你在一个陌生城市旅行。

+

+早上醒来,你想:今天天气怎么样?要不要带伞?

+

+你打开天气APP看了一眼——有阵雨。

+

+于是你调整计划:上午去博物馆躲雨,晚上再去看夜景。

+

+这个"想→做→看→再想"的过程,就是ReAct在做的事。

+

+### 三个阶段

+

+ReAct由三个部分构成:

+

+**思考(Thought)**:分析当前问题,决定下一步做什么。比如"用户问的是某国人口,我需要查数据"。

+

+**行动(Action)**:调用外部工具。输出格式类似`search(query="某国人口")`。

+

+**观察(Observation)**:工具返回结果,成为下一轮思考的依据。比如`{"population": "1.4亿"}`。

+

+循环往复,直到任务完成。

+

+

+

+### 什么时候停下来

+

+两种方式:

+

+- **硬限制**:设个最大迭代数,比如`max_iterations=10`,到了就强制结束。

+- **条件触发**:模型觉得自己很有把握了,或者连续失败好几次,就主动收手。

+

+## 技术实现

+

+### 工具怎么设计

+

+三个原则:

+

+**原子性**:一个工具只做一件事。计算器就做计算,搜索就做搜索,别搞大而全。

+

+**强契约**:用JSON Schema定义清楚输入输出格式:

+

+```json

+{

+ "name": "get_weather",

+ "description": "查询指定城市的天气信息",

+ "parameters": {

+ "type": "object",

+ "properties": {

+ "location": {

+ "type": "string",

+ "description": "城市名称,如北京、上海"

+ }

+ },

+ "required": ["location"]

+ }

+}

+```

+

+**安全第一**:删数据、转账这类敏感操作必须有权限控制。

+

+### 提示词怎么写

+

+ReAct提示包含四个部分:

+

+- 要求模型展示思考过程。

+- 告诉它有哪些工具可以用。

+- 提示它在每个操作后重新评估。

+- 设定循环退出条件。

+

+### 从提示词到原生工具调用

+

+早期做法是在提示词里格式化输出:

+

+```

+思考:我需要查询北京的天气

+行动:get_weather(location="北京")

+观察:{"temperature": "25℃", "condition": "晴"}

+```

+

+问题很明显:模型可能"废话连篇",格式也可能乱套。

+

+后来有了**原生工具调用**,直接微调模型让它输出结构化JSON。稳定多了,还能并行执行多个工具。

+

+

+

+### 在Java中使用ReAct:LangChain4j示例

+

+如果你是Java开发者,可以用 LangChain4j 快速实现 ReAct。核心思路是:用 `@Tool` 注解定义工具,框架自动处理推理-行动-观察的循环。

+

+**第一步:定义工具**

+

+```java

+import dev.langchain4j.agent.tool.Tool;

+

+public class WeatherTools {

+

+ @Tool("获取指定城市的实时天气信息")

+ public String getWeather(String location) {

+ // 实际项目中调用天气API

+ return switch (location) {

+ case "北京" -> "晴天,15℃,空气质量良好";

+ case "上海" -> "多云,18℃,有轻度雾霾";

+ default -> "未找到该城市的天气信息";

+ };

+ }

+

+ @Tool("查询股票实时价格")

+ public String getStockPrice(String stockCode) {

+ // 实际项目中调用股票API

+ return "股票" + stockCode + "当前价格:168.5元,涨幅+2.3%";

+ }

+}

+```

+

+**第二步:创建助手接口**

+

+```java

+import dev.langchain4j.service.AiServices;

+

+public interface Assistant {

+ String chat(String userMessage);

+}

+```

+

+**第三步:构建并使用**

+

+```java

+import dev.langchain4j.model.openai.OpenAiChatModel;

+

+public class Main {

+ public static void main(String[] args) {

+ // 配置模型

+ OpenAiChatModel model = OpenAiChatModel.builder()

+ .apiKey("your-api-key")

+ .modelName("gpt-4")

+ .build();

+

+ // 构建助手,绑定工具

+ Assistant assistant = AiServices.builder(Assistant.class)

+ .chatLanguageModel(model)

+ .tools(new WeatherTools()) // 注册工具

+ .build();

+

+ // 提问——框架会自动执行ReAct循环

+ String answer = assistant.chat("北京今天天气怎么样?适合户外运动吗?");

+ System.out.println(answer);

+ }

+}

+```

+

+**运行时发生了什么?**

+

+当用户问"北京天气怎么样"时,LangChain4j 内部会:

+

+1. **思考**:模型分析问题,决定调用 `getWeather` 工具。

+2. **行动**:执行 `getWeather("北京")`。

+3. **观察**:得到 "晴天,15℃,空气质量良好"。

+4. **再思考**:模型结合天气数据,判断适合户外运动。

+5. **最终答案**:返回完整回答。

+

+整个过程对开发者透明,你只需定义工具,剩下的交给框架。

+

+**两种模式的区别**

+

+| 模式 | 适用场景 | 特点 |

+|-----|---------|------|

+| 函数调用(推荐) | OpenAI、Claude等支持工具调用的模型 | 稳定可靠,直接输出结构化调用 |

+| 文本解析 | 开源模型、不支持工具调用的模型 | 通过提示词让模型输出 `Action: xxx` 格式,再解析 |

+

+LangChain4j 会根据模型类型自动选择模式。如果你的模型支持函数调用,优先用这个——更稳定,不容易出错。

+

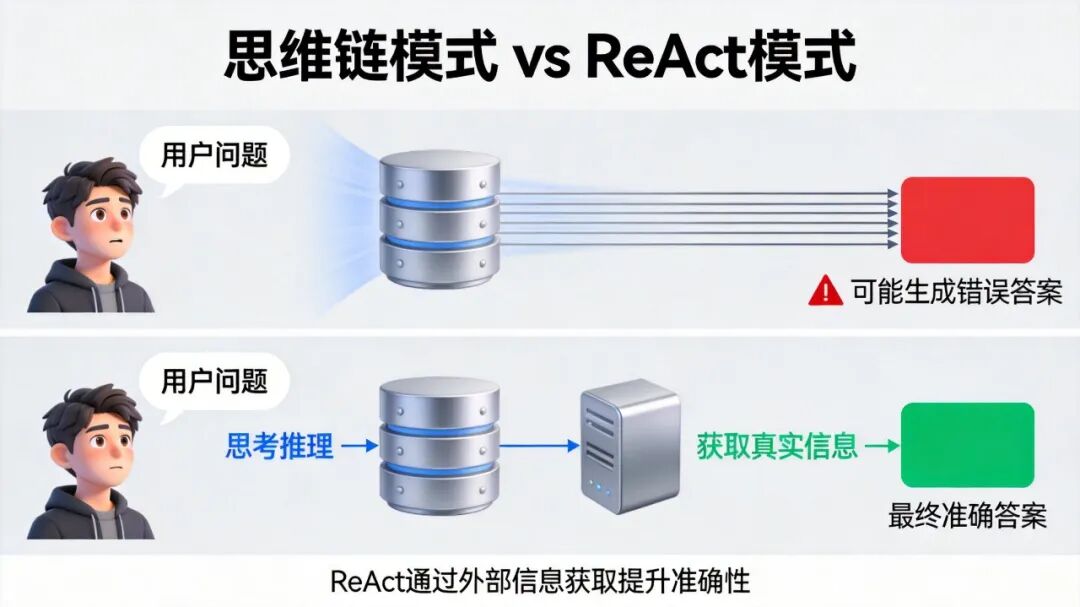

+## 为什么ReAct管用

+

+

+

+### 减少胡说八道

+

+假设用户问:"今天A股涨得最多的是哪只?"

+

+普通模型可能直接猜"茅台"——反正训练数据里有。

+

+ReAct模型会:

+1. 想到:我得查实时数据。

+2. 调用股票API。

+3. 看结果:涨最多的是XXX。

+4. 根据真实数据回答。

+

+不靠记忆,靠查证。

+

+### 出了问题能追溯

+

+用ReAct,系统可以展示完整的推理链条。客服答错了?直接看:它问了什么、查了什么、最后怎么答的。开发者定位问题快多了。

+

+传统模型只能两手一摊:"抱歉,我不知道为什么会那样。"

+

+### 能随机应变

+

+比如订餐场景:用户说"帮我订个餐厅,要近、评分高、适合商务"。

+

+ReAct会:

+1. 获取用户位置。

+2. 搜附近高评分餐厅。

+3. 筛选适合商务的。

+4. 发现首选满了,自动推荐备选。

+

+脚本做不到这种灵活调整——它只会报错或者返回固定结果。

+

+### 能组合多个工具

+

+写一份市场分析报告?ReAct可以协调搜索工具查数据、代码工具做分析、图表工具可视化、写作工具生成报告。模拟的是一个真实分析师的工作方式。

+

+## 工程实践

+

+

+

+### 避免死循环

+

+智能客服常见问题:用户问"客服电话多少",系统没有这个功能,模型就一直绕圈。

+

+解决办法:

+

+**硬限制**:

+

+```python

+max_iterations = 10

+for i in range(max_iterations):

+ # 执行循环

+ if i >= max_iterations:

+ return "处理超时,请稍后重试"

+```

+

+**循环检测**:同一个操作重复3次,直接判定无法回答,退出。

+

+**系统提示引导**:告诉模型"最多试3次,还是不行就说不知道"。

+

+### 上下文管理

+

+长对话容易爆窗口。比如分析50份简历,每份都查背景信息,上下文直接撑满。

+

+处理方式:

+

+**截断**:只保留最近10轮对话,早期内容丢掉。

+

+**摘要**:把前面的分析压缩成一句话,比如"20份简历分析完成,12份通过初筛"。只留结论,不留过程。

+

+省Token,效果差不多。

+

+### 并行调用

+

+问:"对比北京、上海、深圳国庆期间的天气和机票价格。"

+

+串行做法:查北京天气→等,查上海天气→等,查深圳天气→等,查北京机票→等……6次等待。

+

+并行做法:三个城市天气一起查,三张机票一起查。2次等待搞定。

+

+性能差距明显。

+

+### 错误处理

+

+订机票时支付API返回"网络超时",怎么办?

+

+**分级处理**:

+- 网络超时:等1秒重试,最多3次

+- API限流:换备用支付渠道

+- 余额不足:提示充值

+- 系统维护:告知稍后再试

+

+**回退机制**:主渠道失败自动试备用渠道,都失败了保存订单状态,让用户晚点再试。

+

+## 结语

+

+ReAct让AI从被动应答变成主动规划。通过把推理和外部工具结合起来,AI能处理远超传统聊天机器人的复杂任务。

+

+它的核心其实很朴素:**像人一样做事**。想一下、做一下、看结果、接着想。

+

+挑战也不少。循环控制、上下文管理、错误处理,都需要认真对待。但随着技术成熟,基于ReAct的AI智能体正在各个场景里发挥作用。

+

+如果你在搞AI应用,ReAct值得深入了解。

diff --git "a/docs/md/AI/\344\270\272\344\273\200\344\271\210ChatGPT\350\203\275\345\220\254\346\207\202\344\275\240\350\257\264\347\232\204\350\257\235\357\274\237Embedding\346\212\200\346\234\257\346\217\255\347\247\230.md" "b/docs/md/AI/\344\270\272\344\273\200\344\271\210ChatGPT\350\203\275\345\220\254\346\207\202\344\275\240\350\257\264\347\232\204\350\257\235\357\274\237Embedding\346\212\200\346\234\257\346\217\255\347\247\230.md"

new file mode 100644

index 0000000..f14955d

--- /dev/null

+++ "b/docs/md/AI/\344\270\272\344\273\200\344\271\210ChatGPT\350\203\275\345\220\254\346\207\202\344\275\240\350\257\264\347\232\204\350\257\235\357\274\237Embedding\346\212\200\346\234\257\346\217\255\347\247\230.md"

@@ -0,0 +1,196 @@

+ChatGPT、Claude这些AI助手能理解我们说的话,还能给出像样的回答。做到这点,靠的是Embedding技术。

+

+没有它,大语言模型根本没法处理文字输入。Embedding把人类语言变成数字,让机器能"读懂"。

+

+## 什么是Embedding

+

+Embedding就是把词语、句子变成一串数字。听起来简单,但背后的想法很有意思。

+

+我们说"北京"这个词时,脑子里会想到:城市、首都、政治中心、文化古都。这些概念连在一起,构成我们对"北京"的理解。Embedding做的,就是把这种理解映射到数学空间里。

+

+每个词变成一个向量——一组数字。有意思的是,语义相近的词,向量也靠得近。"北京"和"上海"的向量距离很近,都是城市。但"北京"和"苹果"就离得远,语义完全不同。

+

+

+这是我学习Java的知识总结,我会按照下面的技术栈一步步完善整个知识体系。

-**文章首发公众号**。如果有帮助到大家,希望点个**Star**!让我有持续的动力,感谢🤝

+分享给正在学习Java的你们,希望可以帮助你们少走一些弯路,一起学习进步!

-每周至少一篇的更新频率,没链接的是之后打算写的。

-

-:pencil2: [写作自述](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486050&idx=1&sn=1105d28b8d3553715f425419ec9d8d18&chksm=cf8479a7f8f3f0b19425e08a00332bbce4e5333843cfd6dd6f35e892139810d86b778cd57d55#rd)

+**文章首发公众号,每周至少一更。如果有帮助到大家,希望点个Star!让我有持续的动力,感谢🤝**

### :star: Java ###

- [深入详解ThreadLocal](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486776&idx=1&sn=f4425cb88bc5393e4d5125f5fd08ed68&chksm=cf847efdf8f3f7ebc79c5bcd3c47f1fc2f83abf119c2b22782cc90a1c69f606a95a4051dab53#rd)

-

- [使用Optional优雅避免空指针异常](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486914&idx=1&sn=b2b0f2c41b8168fbfcf1df21a3e00acb&chksm=cf847e07f8f3f711de06cb9269ba41541ec9399a56963768add081031566bf7fa49cbb6f7fa0#rd)

-

- [我画了35张图就是为了让你深入 AQS](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486172&idx=1&sn=b39cccd87dcd21176597dce0b15f7232&chksm=cf847919f8f3f00f86219d44cd95badee969d754aec89e644992437f2e8e0f7ad784695b4d90#rd)

-

- [一个 static 还能难得住我?](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486175&idx=1&sn=041c85c052c11d2d15243994bc46d90a&chksm=cf84791af8f3f00c90a18b29d1fa47c9bcd713651514fc5ce4a9f82d656fe637bb21d45c42be#rd)

-

- [原来这才是动态代理!!!](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486178&idx=1&sn=9610c1a0fa1df4c69558408ab2a3fcae&chksm=cf847927f8f3f0315b0c86f9b577926820c3d264d605149f850b597fcd17fafe432d82aaffcf#rd)

-

- [synchronized 的超多干货!](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486181&idx=1&sn=4cb9340ba2f19ccb19ccec0c54d61b86&chksm=cf847920f8f3f036cd752455290a97f6584f8a4ce9662d1102515dd5ed967c94e14cec7a767d#rd)

-

+- [ExecutorCompletionService详解](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487958&idx=1&sn=2ace7ac53d596cd909d1d1c7e96fbff2&chksm=cf846213f8f3eb05c9de1fab2c609f4774ca86497ad5542a26aae5928efd808bfd865738aa4f#rd)

+- [CompletableFuture深度解析](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247488046&idx=1&sn=2bb0b6dc4576278ff2e7f9b917cb6fe8&chksm=cf8461ebf8f3e8fd013d08c5028d41281444b1ac1d60f1706c841c4b444a4235d82c84644b9b#rd)

+- [面试官:响应式编程和虚拟线程怎么选?看完这篇不再被问倒](https://mp.weixin.qq.com/s/V7H_hyjycT3n1Rr7FBOrYQ)

### :page_facing_up: JVM ###

- [面试官:JVM是如何判定对象已死的?学JVM必会的知识!](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486087&idx=1&sn=c6f1a9932961095ffdf2aef8a789e115&chksm=cf847942f8f3f0549c798671fe804c93378586b4fc547cce14db2359852ff0723a3aab64a187#rd)

-

- [GC的前置工作,聊聊GC是如何快速枚举根节点的](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486168&idx=1&sn=9eef35ec701b5c2f8097641b7e69ae71&chksm=cf84791df8f3f00b1e85039f31b17e00bf9cb624bbee638efeca110e51df6c6b6ba6363705ee#rd)

-

- [GC面临的困境,JVM是如何解决跨代引用的?](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486242&idx=1&sn=83d4ace26fea86b0f16e93e25b3cdadf&chksm=cf8478e7f8f3f1f17a65a7fc0d25237e8f25b90f300085bb5a7e8128f7d80f5ba1a02e5a6c2f#rd)

-

- [昨晚做梦面试官问我三色标记算法](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486265&idx=1&sn=1464f25915c2c09ef65b784985b76fa3&chksm=cf8478fcf8f3f1ea80715ae949c1b4aec988368ead269c746d38244ae62028948a199f099d14#rd)

-

- [深入解析CMS垃圾回收器](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486628&idx=1&sn=984b273af7d1d0398517a2f5442ffb38&chksm=cf847f61f8f3f677372a5ebc9f81403a8324be1bed49bf92e763882715c943324de4f1b0139a#rd)

-

- [深入解析G1垃圾回收器](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486736&idx=1&sn=5e0710485783c3bcc4854a10412b9a40&chksm=cf847ed5f8f3f7c3826fa8c67bc76ce8dd218a725ee04f54cdafa27e14d190f5c92332589ae2#rd)

-

- [深入解析ZGC垃圾回收器](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486746&idx=1&sn=7257ecf8c36509d06be359e3889400f2&chksm=cf847edff8f3f7c96edc667051d9ef70537000202c1ec77699fa5e30e46c2c8ddabd122297f3#rd)

### :hammer: MySQL ###

-- [MySQL双写缓冲区(Doublewrite Buffer)](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247484456&idx=1&sn=b5154c5eb26b969655c1b430792e0cb6&chksm=cf8477edf8f3fefbe0c95c2074a461ab12c01926654d995ad7844cba332fda7744da6b47ddc5#rd)

+- [深入解析 MySQL 双写缓冲区](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487013&idx=1&sn=beae861ca0f148e010d4170d14f67fdd&chksm=cf847de0f8f3f4f631273fbc7b9739239772cf90ad94fe78e83eb006d6a700ba2f00faffac09#rd)

- [再深入一点|binlog和relay-log到底长啥样?](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486183&idx=1&sn=adc83df6c78e53ed1aefec7edc40ed63&chksm=cf847922f8f3f034beb08fc0a6fa2df8acb64902adff6927b71b5582e54444baa5c7265f7db8#rd)

@@ -53,29 +43,35 @@

- [听说你对explain 很懂?](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486188&idx=1&sn=4ebf475e7287e4b9cc0e37fdff0c18af&chksm=cf847929f8f3f03fba7173a17f8a04a677db9af91355cba552f5156b7fc9424ccf0fd87f8488#rd)

-- [MMR(Multi-Range Read Optimization)](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247484466&idx=1&sn=29b6a9adfa2fee52e6391509d1b8c73f&chksm=cf8477f7f8f3fee1ea1793924cf8475f7581a2770f8804a54a60c61f57aac4ce64dff723c308#rd)

+- [深入浅出MySQL MRR(Multi-Range Read)](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487041&idx=1&sn=66921cd6949db1389a0f02b3764b250f&chksm=cf847d84f8f3f4925b6506aeabe55308c85a68cb1fb8bf09aa99eca721d881246700bd9851a4#rd)

- [拿捏!隔离级别、幻读、Gap Lock、Next-Key Lock](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486190&idx=1&sn=c274fbc3daed3d1ac3a1ce5bd0009b68&chksm=cf84792bf8f3f03d07e2855570164cbfc0f0a7fbb0bba1fd50c8b7b2155c555c4438b625f395#rd)

-- [MySQL中的Join 的算法(NLJ、BNL、BKA)](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247484480&idx=1&sn=e75482a0fd8a866d9a9565aa9e659009&chksm=cf847785f8f3fe93195de380f7cff3efc8950a2cb49127a669f6b14a30e2fa5c13285e905f6b#rd)

+- [深入理解MySQL中的Join算法](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487068&idx=1&sn=042ab289718dbdaaea1b62854610efb7&chksm=cf847d99f8f3f48fd0aa04eeb2f6932bc826770f80911eec2fc571bdc7a50abc387714488d72#rd)

-- [MySQL分区表详解](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247484856&idx=1&sn=ffb350c8b1e74667fe15a5e808faec57&chksm=cf84767df8f3ff6b30ff91dd14a6f802eaac01076dcc8b988a18f1a529f21a6266d34e34c4d7#rd)

+- [MySQL分区表详解](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487126&idx=1&sn=d81d7fa7b2befa0637bc9df5f4292915&chksm=cf847d53f8f3f445c92c1ae37478e47be947829a70b68d1e0f7f7d74af2d7ee15e6fca657845#rd)

- [缓存和数据库一致性问题,看这篇就够了](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486196&idx=1&sn=e9dcd1824583546aada0096e457afda0&chksm=cf847931f8f3f02780828e9fb2b2f36d018d74583fb7091bdbe6b7565bdfa10a396b4bfa9965#rd)

+- [全网最详细MVCC讲解,一篇看懂](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487999&idx=1&sn=8abdf89c27bbedd788d6ea260cb981c3&chksm=cf84623af8f3eb2cd63c4f6f80fda0822d14c3bbf49487f254377f13963ccaf89b1d04344128#rd)

+

+- [六个案例搞懂间隙锁](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247488470&idx=1&sn=2a2b56e35ac6e1bae83e1a7eadc743f1&chksm=cf846013f8f3e9051b5e0d3636bcf135b994d77039409f92b7faeccdedddb6d5cfda6eaf0984#rd)

+

### :envelope: Redis ###

- [Redis类型(Type)与编码(Encoding)](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486922&idx=1&sn=98b7e28fc9ed20b69dc236605dfd1c34&chksm=cf847e0ff8f3f7197ece7d7b96c7fa82328d7e66b969a37246ac51f4c4dd21056540b046cbe6#rd)

+

+- [Redis性能优化:理解与使用Redis Pipeline](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486953&idx=1&sn=76365046920ead36714bbdf64300739b&chksm=cf847e2cf8f3f73ab5dc16d82817bde96a5ba5f16903896bae2943773df87a11153c612eeeb9#rd)

-- [布隆过滤器](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247484400&idx=1&sn=8d480b6b87ee2330e1e5f181fbf5f71a&chksm=cf847035f8f3f923699cd0b3c9137aa6bd596abd0242abe73abeee3179392794538e87e2dc42#rd)

+- [布隆过滤器:原理与应用](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487003&idx=1&sn=c98c8a0643ae56ac0d81572aeabcc279&chksm=cf847ddef8f3f4c86f14b317375e395124f9278e5dbd7daec854a8a342f77992f1e6b9775249#rd)

-- [Redis跟MySQL的双写问题](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247484390&idx=1&sn=de37dc02c20f3b471404c507c3741550&chksm=cf847023f8f3f935233feb3c575c7798e41d695347f11f502a75f25ba02b479ad152572c666e#rd)

+- [探索 Redis 与 MySQL 的双写问题](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486966&idx=1&sn=1aa2fc4d096242a8b725e01d45327a0c&chksm=cf847e33f8f3f72529da952b0621f7faf1756e5fd24e50c0d1896d98eab097e5bbf74aa218dd#rd)

- [Redis内存碎片:深度解析与优化策略](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486935&idx=1&sn=0b41d8807b6f0cdd06172f587884aa7a&chksm=cf847e12f8f3f70469ee692017388360a767175c9a3cbe482f2d93232c52540e43e5c8c8034e#rd)

-- [Redis中的BigKey问题:排查与解决思路](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247484415&idx=1&sn=39cb685de9880bbe8fb108518cd5d54d&chksm=cf84703af8f3f92ca802e8e567a1f9bcdd038574113fe7aa68091db9f32cd86f6957862ee83a#rd)

+- [Redis中的Big Key问题:排查与解决思路](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487157&idx=1&sn=9cc48fd498f6633fdc49c11f7cd6b88f&chksm=cf847d70f8f3f466319083703cff3623d0ec92a6d47d9594c4b0547d9489805dfefba2ecd179#rd)

-- [非看不可的Redis持久化](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247484435&idx=1&sn=e02f552e3d943787fdd5442ab49eb95a&chksm=cf8477d6f8f3fec05b7b8441cc19898bf9a4c4e9ffaa72827eba2e20735a0f37f840c4e2e495#rd)

+- [超详细!彻底说明白Redis持久化](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247488849&idx=1&sn=d15830cf43364a8c9e3c9292d53cce05&chksm=cf846694f8f3ef825cb84436e2c931d9e22c2cdf810a546a3edb301a539168e0ce33c868d115#rd)

- [深度剖析:Redis分布式锁到底安全吗?看完这篇文章彻底懂了!](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486194&idx=1&sn=59c36ccae0a67063e4b29aba5084ffe0&chksm=cf847937f8f3f0211b989c65ff07c8b142ddd7752592f018488cb852a9062b587bbe8b2b3d3e#rd)

@@ -84,28 +80,40 @@

- [Redis最佳实践:7个维度+43条使用规范,带你彻底玩转Redis | 附实践清单](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486200&idx=1&sn=52dc758e32d138efcba25a7a47aec23d&chksm=cf84793df8f3f02b497d68f6f9407f7681b7eda3b2c88c87ac0f0411a7d0df4cf2ec8b9ba781#rd)

- [颠覆认知——Redis会遇到的15个「坑」,你踩过几个?](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486202&idx=1&sn=5fee614b5272fb9e3522f446bddc6132&chksm=cf84793ff8f3f02961bdccd2310d052231bc3023cd609afe71d7e648bcda48aa2c57eed65371#rd)

-### :lock:Elasticsearch ###

-- [学好Elasticsearch系列-核心概念](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247485450&idx=1&sn=b23b362f8baac883e6a64b0cb05b184d&chksm=cf847bcff8f3f2d98ef829ff3f7c8cee59600b6b2c683564e2ab6af2c0547fc67b8ccbc837e9#rd)

-

-- [学好Elasticsearch系列-索引的CRUD](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247485479&idx=1&sn=eb2b57e78d1f08c398558b2f23063df0&chksm=cf847be2f8f3f2f4567bd65048aba533355c70733bef9a14580ffcfadd01678acf01d62a92f4#rd)

-

-- [学好Elasticsearch系列-Mapping](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247485492&idx=1&sn=e33d0689502b043723b0c2e4f0660a1d&chksm=cf847bf1f8f3f2e75fc2a8dd4542572f2dc7e4706f4817d2f9cd2ae18d3f28a1455da7873207#rd)

-

-- [学好Elasticsearch系列-Query DSL](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247485520&idx=1&sn=97803ad983c80a90158b5b9efabcc8b7&chksm=cf847b95f8f3f2839fec2550df3dccb55e91b5cadcfc11ea2e9e25b27a882aceb5dca5fe2b96#rd)

-

-- [学好Elasticsearch系列-分词器](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247485544&idx=1&sn=cfa20adbb5c7328ea0cab85966d95c02&chksm=cf847badf8f3f2bbefd1b9e893cccf10a24c2a83f8052b613c62c999566e4c8616fded236552#rd)

-

-- [学好Elasticsearch系列-聚合查询](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247485562&idx=1&sn=dd965afcd5697a152dae32d46e3996cd&chksm=cf847bbff8f3f2a91c7c75af03809359f7c9963c32e1da19b79939ccc283c46b3cf8038bd917#rd)

-

-- [学好Elasticsearch系列-索引的批量操作](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247485594&idx=1&sn=71da9fcc473e3891b19c37af782ae7cb&chksm=cf847b5ff8f3f249e7f42ccac125982aa3abd8617bb5cc5466b2c5d381dae51f4d76b9f11d3c#rd)

-

-- [学好Elasticsearch系列-脚本查询](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247485648&idx=1&sn=a0b075e6c2bad836a4c4eb6cacbaff5a&chksm=cf847b15f8f3f2033b5e18b8376b14205902898fb14c40a955a10619a74b1d35552a046dd7d1#rd)

+### :lock: Elasticsearch ###

+

+- [一起学Elasticsearch系列-核心概念](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487646&idx=1&sn=381af0374eb1d512046315164a541211&chksm=cf84635bf8f3ea4d650dc00e277d273d9a1e7358ae884b3cfedaf9d172cb1f44df7775bf355a#rd)

+- [一起学Elasticsearch系列-索引的CRUD](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487642&idx=1&sn=ea2cc5a3e0be25a0a81abe860b183f09&chksm=cf84635ff8f3ea49944ad35ee9bba7e60bf3f9c9c72d83c3d103403739d58a49fe2ff4779314#rd)

+- [一起学 Elasticsearch 系列 -Mapping](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487661&idx=1&sn=40c8a1a43c172c8500b975c6e1b35b39&chksm=cf846368f8f3ea7e451022e0e72b1a9d57c2641d56f9d0158fb8849d2806294e3dc7e3f71cde#rd)

+- [一起学Elasticsearch系列-Query DSL](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487687&idx=1&sn=9622f7220358daab3a5dddd9fef3d2b7&chksm=cf846302f8f3ea147dac58d003d20495ce1feeec910423e59d917272e890590d7b769ec71510#rd)

+- [一起学 Elasticsearch 系列-分词器](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487710&idx=1&sn=bce31911a3259f77cd5f5874c255e74c&chksm=cf84631bf8f3ea0dd8c2b816950f1fe7f04f529abf02512ca778b8e2fa2b66b117f15d6d44bb#rd)

+- [一起学Elasticsearch系列-聚合查询](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487728&idx=1&sn=f4e43d386925b7cec5115fb388e00843&chksm=cf846335f8f3ea2371df0bfbb16b1f6c2dfb553d90762edd9bec9c2b9839f6043de4625c1a36#rd)

+- [一起学Elasticsearch系列-脚本查询](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487750&idx=1&sn=b7b7bdcc8736d4bfc2092bd5c3511084&chksm=cf8462c3f8f3ebd526b06d283b723844d548299957e4a8d1c5cf60e1a6fa70b5e97477f7cca8#rd)

+- [一起学Elasticsearch系列-索引的批量操作](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487779&idx=1&sn=54d06ae4f6a1aa62702cc61349e763b2&chksm=cf8462e6f8f3ebf026fe41fc0c8fb77b743687f0460a5eae970c2af95264e3556764911b2f1d#rd)

+- [一起学Elasticsearch系列-模糊搜索](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487791&idx=1&sn=5878be01f10e3834445c64cb6351a872&chksm=cf8462eaf8f3ebfcb0a49c57d68721448d649b1dfcd91f3af549ef1192c95fb6a00d25c386db#rd)

+- [一起学Elasticsearch系列-搜索推荐](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487818&idx=1&sn=ee11f629be04cf427193d0fee36bc6e2&chksm=cf84628ff8f3eb99baaa38cfcd126a5c11143a5e14e8571e33b1ddada1403001a7c955f1486f#rd)

+- [一起学Elasticsearch系列 -Nested & Join](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487856&idx=1&sn=d13fbb78f8093ef1ac85f4f4b4abe543&chksm=cf8462b5f8f3eba3ad95ad2cead38c8413565262917cb2a10c5f7c5287189f600a93014ffcca#rd)

+- [一起学Elasticsearch系列-深度分页问题](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487873&idx=1&sn=37c93764bd0ddad6c5d7a7b01d9eca3a&chksm=cf846244f8f3eb529197122f0bc15256c7cf865d1c2f7b23d2fee8dcd1259a5d02e2fc12da54#rd)

+- [一起学Elasticsearch系列-并发控制](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487882&idx=1&sn=9afba52dddff1e9a7269bc9dc23e4893&chksm=cf84624ff8f3eb597c445f21a71df24bc334d58b1108432fcf5acf92498cfb8a22fee07af059#rd)

+- [一起学Elasticsearch系列-写入原理](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487898&idx=1&sn=b9960c61fb853619d1e52258cb5819a0&chksm=cf84625ff8f3eb492810d73713742b8459688fe7f9ef803354734bd9aceb7cdbc550a0ba6a17#rd)

+- [一起学Elasticsearch系列-写入和检索调优](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487903&idx=1&sn=45211a9d2b39c8433208f95af3ff3922&chksm=cf84625af8f3eb4c542e4b4082064e5abd2f2e21806a8f3e15409e02660afd820a4e5b854a9b#rd)

+- [一起学Elasticsearch系列-索引管理](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487926&idx=1&sn=3e7a6e6de02de000657b142d4bee5e82&chksm=cf846273f8f3eb656a9be4fa060dc23f1aba6ac3ca0b41087511a5787fe8b523a4c1db9bda15#rd)

+- [一起学Elasticsearch系列-Pipeline](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247488897&idx=1&sn=2d4adc6d38813efa5a66a4f7c2763375&chksm=cf846644f8f3ef52577656d9a6d9cf5dbaef7f6dc61d21df181c61279237380f9ddd111fad69#rd)

+

+### :mag_right: DDD ###

+

+- [熬夜整理的2W字DDD学习笔记](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247489048&idx=1&sn=6dc6f884fe7ca0e07d86aaa6e37ba4ab&chksm=cf8465ddf8f3eccbae516e3405dff032dfcc0c2820b187f4188caca2e63bed88d99fbb11b8c1#rd)

-### :date:框架 ###

+### :birthday: Spring ###

+

+- [如何优雅地Spring事务编程](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247489087&idx=1&sn=60d6e29a87753beb69754bb633cbfe6e&chksm=cf8465faf8f3ececad33d8f42a7644e44eb05081c613761b39fc4bf46425058e9e3e5bbcf52b#rd)

+

+### :date: 框架 ###

- [本地缓存无冕之王Caffeine Cache](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486885&idx=1&sn=37c7a9461402bd97822295cf51361777&chksm=cf847e60f8f3f776eb3b477decfbac55dc8b7ae1cf607ef68fbee89dbe02d40a800a92fabec7#rd)

+- [响应式编程不只有概念!万字长文 + 代码示例,手把手带你玩转 RxJava](https://mp.weixin.qq.com/s/r0DJiOxR8wnZZ6tIKrSPzg)

-### :fire:架构设计 ###

+### :fire: 架构设计 ###

- [高并发系统设计之负载均衡](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486811&idx=1&sn=5422c62878ee1ddcc6ee1da45deb78d7&chksm=cf847e9ef8f3f7889c94fe93796c87083ebb47680ef13b40a35f5127c293e5d44fd3621abd57#rd)

@@ -115,22 +123,67 @@

- [搞懂异地多活,看这篇就够了](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247486192&idx=1&sn=6c82786cf2403486d81f375be684f228&chksm=cf847935f8f3f023a167ea3272a35979ee623dd0207acb70a0898148a1b18a15df01a49e54d8#rd)

-### :dash:编程语言 ###

+- [12306技术内幕](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247489137&idx=1&sn=9f5857733a5bed241902fb4c4421adf3&chksm=cf8465b4f8f3eca2d7d65af8cd8a1b3e9b1b3b56d482eb09cdd5fdd0ae3b7744a3994c495cbf#rd)

-- [Scala初学者指南](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247484574&idx=1&sn=85ac7b748ec8f22e3e8f8f42efca02d1&chksm=cf84775bf8f3fe4d2779871e106e1946293bb57d6f85ad44aa1f20fe467e9402a26807a532b4#rd)

-

-- [Groovy初学者指南](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247484641&idx=1&sn=7243e662d2b0a811f1be745777c30420&chksm=cf847724f8f3fe329f4414fb3fa9c262e0d2985f6996b64b519b79b1c6ae3f65fb894d27bb76#rd)

+- [业务幂等性设计的六种方案](https://mp.weixin.qq.com/s/HZAkGPNrC05aeHabhqT-zA)

-### :eyes:大数据 ###

+### :dash: 编程语言 ###

-- [Spark入门这篇就够了(万字长文)](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247484731&idx=1&sn=033b31376869f2046219dfe28707e43d&chksm=cf8476fef8f3ffe86a1910e5948afddba464e6cc186adb3ecb8ca62f612a4110b71ada2370cc#rd)

-

-- [一篇文章带你入门HBase](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247484823&idx=1&sn=4f8204e007c2201962cd707fc5668242&chksm=cf847652f8f3ff443ef516bf490656b21891eee42382970435a25451948daf89c2d72cfad96f#rd)

-

-- [全网最详细4W字Flink入门笔记(上)](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247485174&idx=1&sn=4cbd4ce941458fa576febb5021d1942f&chksm=cf847533f8f3fc25fa6e9c0c6de69b68b3f424aad52e6846dca8641d11a8be7ea8614682ad64#rd)

+- [Scala语言入门:初学者的基础语法指南](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487245&idx=1&sn=d089e22890f1f7449b7cf34e3cf2f6ed&chksm=cf847cc8f8f3f5deb39556f4229bafb6f1498906dc1d75040f90817bf0396117a7c2cdb498f9#rd)

+- [Groovy 初学者指南](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487066&idx=1&sn=da9e3a9aff377d383e34e537e2f55666&chksm=cf847d9ff8f3f489011f26a784302ee68b9c1d7d57d52bc2c924a7c9b1a5f528ef2a417114c0#rd)

+- [自研 DSL 神器:万字拆解 ANTLR 4 核心原理与高级应用](https://mp.weixin.qq.com/s/nFiEqhi1B_SxrZGCAqLgLw)

+

+### :satellite: 设计模式 ###

+

+- [一文搞懂设计模式—策略模式](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247488583&idx=1&sn=2e4758ee1b48dc5884289d5ecb841491&chksm=cf846782f8f3ee946d514e6267a326facb6880002fb663ffdbc3347e1d89fab32b8c0f5764d9#rd)

-- [全网最详细4W字Flink入门笔记(下)](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247485365&idx=1&sn=c99d1e392440cad85342fdc950afc7f9&chksm=cf847470f8f3fd6632b34a42d8008f94430902630e4f5c8fb6ead1475facdc6e4ab39a5f828b#rd)

+- [一文搞懂设计模式—责任链模式](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247488600&idx=1&sn=dd004bacfe0262fcc0fd1d72ae506b7a&chksm=cf84679df8f3ee8bf7117c5bed745470475c1a35ee96fe2bb99e093d895b7b776ecf51bb31c2#rd)

+

+- [一文搞懂设计模式—单例模式](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247488615&idx=1&sn=1f0f92f6180856dbf206706c071438a3&chksm=cf8467a2f8f3eeb4e24e6c42f7f8cd265c03939ffa7742d1445ed7dddc6b11bb63aa6b0eb95e#rd)

+

+- [一文搞懂设计模式—观察者模式](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247488718&idx=1&sn=9486e6b494c666e805e321a74bac5591&chksm=cf84670bf8f3ee1da0e7f26963e007da8fa77e7190596c9a6f6296cf2cc70af2ec4c066b5906#rd)

+

+- [一文搞懂设计模式—门面模式](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247488730&idx=1&sn=0f63b2f54615d0647d4be22964dadea2&chksm=cf84671ff8f3ee0900b2cd3174ab8e66131308049648cc4e65d25215a54cc457cea1e73c8698#rd)

+

+- [一文搞懂设计模式—工厂方法模式](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247488747&idx=1&sn=025c94f5b66b4dae3ab6f62dc043a083&chksm=cf84672ef8f3ee38bfce967135b5d23a93c0d59ae502b06b3c85ac629e336d28a21f1e13784f#rd)

+

+- [一文搞懂设计模式—模板方法模式](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247488758&idx=1&sn=40385dc2cd049ab06c6403c47e1d5efa&chksm=cf846733f8f3ee2596eb459b9114e654e5ffd0ca1565931b742c65879a8603fc75c74880be58#rd)

+

+- [一文搞懂设计模式—适配器模式](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247488766&idx=1&sn=78bf2e392394bb28272cceb3dd300618&chksm=cf84673bf8f3ee2d8b6308d272e8cd3a0173bfd540639cd7c17c4c40f6bc3e25561a0889930d#rd)

+

+- [一文搞懂设计模式—装饰器模式](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247488773&idx=1&sn=287d0323b84eec284a56edceb1e5840e&chksm=cf8466c0f8f3efd6e8a8e5270ed10cf991c7b27a93521359274c2120d9e45e29b637e948650f#rd)

+

+- [一文搞懂设计模式—代理模式](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247488866&idx=1&sn=d293faa2c918d85cc9cd8f6bc408b5a1&chksm=cf8466a7f8f3efb11ae68d7f7712bb22ceafae6f9d0529c235a1b1e02d183296c400211910b2#rd)

+

+- [一文搞懂设计模式—享元模式](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247488879&idx=1&sn=2cb5edc9bbb088fd6de2bf9d46cb76cf&chksm=cf8466aaf8f3efbce988a6bf96035714e5125ba8ddc6cfe02871ca73e61c814271608576ff13#rd)

+

+

+### :eyes: 大数据 ###

+

+- [Spark入门指南:从基础概念到实践应用全解析](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487398&idx=1&sn=077859e1109e07b1469d242ec2b8091a&chksm=cf847c63f8f3f575e50012ef3667d9724998f07e32ebd27b6e3a37c5bdf2251d02e89030cff0#rd)

+

+- [HBase入门指南](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487105&idx=1&sn=2ee82c9b239aa502bd3dffcf320b3f93&chksm=cf847d44f8f3f452e1b8ac83b9f62f380e349615b67da92343539d4014077c2ad9e787e256cc#rd)

+

+- [全网最详细4W字Flink全面解析与实践(上)](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487459&idx=1&sn=a1826b2d592fff29b5e11a374468796a&chksm=cf847c26f8f3f53073cc24584264fa2752a26c98bbd31c86bcf519296789eff05d72904d27ac#rd)

+

+- [全网最详细4W字Flink全面解析与实践(下)](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247487535&idx=1&sn=736f1adda56cc550191f17e7111598b5&chksm=cf8463eaf8f3eafc38819e342705df1884683e03d5d39e9df876834ab0a84f61cc55923a5a03#rd)

+

+### :watch:AI

+

+- [深度解析Skills:从Prompt到能力复用的技术革命](https://mp.weixin.qq.com/s/Se6_L1PbhlEUGaBSY8sZsQ)

+- [为什么ChatGPT能听懂你说的话?Embedding技术揭秘](https://mp.weixin.qq.com/s/CoHcpXIaamdfmXCf-3qlgw)

+- [RAG详解:让大模型看见你的私有知识](https://mp.weixin.qq.com/s/mAC3DeqPLM41LyfGh2QjUw)

+- ReAct:让大模型学会边想边做

+- 10分钟掌握 JSON-RPC 协议,面试加分、设计不踩坑

+

+

+### :jack_o_lantern: 其他 ###

+- [良心推荐!几款收藏的神级IDEA插件分享](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247488457&idx=1&sn=f771ccebb84f226e7302b89caa5c056b&chksm=cf84600cf8f3e91aab4564d91feacb8822b53a2b3a79547439d64d2c0b7b293435a1ae79f994#rd)

+- [实战Arthas:常见命令与最佳实践](https://mp.weixin.qq.com/s?__biz=Mzg4Nzc3NjkzOA==&mid=2247488559&idx=1&sn=4b5003cb33446ab4a6173285fe9d83d3&chksm=cf8467eaf8f3eefc033de8f63cba9f0d7b2b5eb0ccfb5209f458a9ab447367b34954f296638b#rd)

+- [Maven实战](https://mp.weixin.qq.com/s/ErtWrRNzjJcR2ettUhAxsQ)

+- [不用Mockito写单元测试?你可能在浪费一半时间](https://mp.weixin.qq.com/s/NICubD9Yq0pn6qwpVIznfg)

+- [用好PowerMock,轻松搞定那些让你头疼的单元测试](https://mp.weixin.qq.com/s/rWIjqJKBQOe72RWW6qyJmA)

### :bulb: 资源 ###

diff --git a/docs/.DS_Store b/docs/.DS_Store

new file mode 100644

index 0000000..1b0a35f

Binary files /dev/null and b/docs/.DS_Store differ

diff --git a/docs/md/.DS_Store b/docs/md/.DS_Store

new file mode 100644

index 0000000..e79a8fe

Binary files /dev/null and b/docs/md/.DS_Store differ

diff --git "a/docs/md/AI/10\345\210\206\351\222\237\346\216\214\346\217\241 JSON-RPC \345\215\217\350\256\256\357\274\214\351\235\242\350\257\225\345\212\240\345\210\206\343\200\201\350\256\276\350\256\241\344\270\215\350\270\251\345\235\221.md" "b/docs/md/AI/10\345\210\206\351\222\237\346\216\214\346\217\241 JSON-RPC \345\215\217\350\256\256\357\274\214\351\235\242\350\257\225\345\212\240\345\210\206\343\200\201\350\256\276\350\256\241\344\270\215\350\270\251\345\235\221.md"

new file mode 100644

index 0000000..f4328dd

--- /dev/null

+++ "b/docs/md/AI/10\345\210\206\351\222\237\346\216\214\346\217\241 JSON-RPC \345\215\217\350\256\256\357\274\214\351\235\242\350\257\225\345\212\240\345\210\206\343\200\201\350\256\276\350\256\241\344\270\215\350\270\251\345\235\221.md"

@@ -0,0 +1,291 @@

+分布式系统中,不同服务之间需要一种可靠的方式来通信。远程过程调用(RPC)是一种常见的选择,而 **JSON-RPC** 是其中比较简单的一种。

+

+这篇文章介绍 JSON-RPC 2.0 协议的核心内容,包括消息格式、错误处理和实际应用场景。

+

+## JSON-RPC 概述

+

+### 什么是 JSON-RPC

+

+JSON-RPC 是一种无状态、轻量级的远程过程调用协议,使用 JSON 作为数据格式。它的设计目标就是简单——协议规范只有几页文档。

+

+JSON 作为数据交换格式,几乎所有主流编程语言都有良好的支持,包括 JavaScript、Python、Java、C#、Go 等。这使得 JSON-RPC 能够轻松实现跨语言调用。

+

+协议本身不绑定传输层,可以跑在 HTTP、WebSocket、TCP Socket 等各种消息传输环境上。开发者可以根据业务需求选择合适的传输方式。

+

+### JSON-RPC 的发展历程

+

+JSON-RPC 有两个主要版本:1.0 和 2.0。

+

+1.0 版本最早提出了基于 JSON 的 RPC 概念,但在规范性方面有所欠缺。2010 年发布的 2.0 版本做了重要升级,加入了批量调用支持、统一的错误对象结构。两个版本通过 `jsonrpc` 字段来区分。

+

+### JSON-RPC 的核心特点

+

+JSON-RPC 有几个值得注意的特点:

+

+- **简洁性**:规范文档很短,请求和响应结构清晰明了。

+- **跨语言支持**:任何能解析 JSON 的语言都可以实现 JSON-RPC 客户端或服务端。

+- **无状态设计**:每个请求独立,协议不维护会话状态。这种设计简化了服务端的实现,也更容易水平扩展。

+- **批量处理能力**:2.0 版本支持在单个请求中包含多个 RPC 调用,服务端返回结果数组。

+- **双向通信**:通过长连接和通知机制,JSON-RPC 也支持服务端主动向客户端推送消息。

+

+## 协议规范详解

+

+### 协议约定与术语

+

+JSON-RPC 规范中使用了 RFC 2119 定义的关键字:MUST、MUST NOT、SHOULD、SHOULD NOT、MAY。这些术语描述了实现者必须、应该或可以遵循的行为规范。

+

+**客户端(Client)**:发起请求的实体,负责构造请求对象并处理响应。

+

+**服务端(Server)**:接收请求并返回响应的实体,处理请求并生成响应。

+

+同一个实现可以同时扮演客户端和服务端。比如在对等网络中,两个节点可能既向对方发起请求,也响应来自对方的请求。

+

+### 数据类型系统

+

+JSON-RPC 继承自 JSON 的类型系统,包含六种数据类型:

+

+基本类型:String(字符串)、Number(数值)、Boolean(布尔值)、Null(空值)

+

+结构化类型:Object(对象)、Array(数组)

+

+这些类型名称首字母必须大写,包括 True 和 False。

+

+成员名称(字段名)在客户端与服务端之间交换时必须区分大小写。函数、方法、过程这三个术语可以互换使用,都指向可以被调用的可执行单元。

+

+## 消息格式深度解析

+

+JSON-RPC 2.0 定义了三种核心消息类型:**请求对象(Request Object)**、**响应对象(Response Object)** 和 **通知对象(Notification Object)**。

+

+

+

+### 请求对象结构

+

+请求对象是客户端向服务端发起 RPC 调用的载体:

+

+```json

+{

+ "jsonrpc": "2.0",

+ "method": "subtract",

+ "params": [42, 23],

+ "id": 1

+}

+```

+

+- **jsonrpc 字段**:协议版本标识,值必须是字符串 "2.0"。

+- **method 字段**:要调用的方法名称,区分大小写。以 "rpc." 开头的方法名预留给 JSON-RPC 内部扩展,如 `rpc.subscribe`、`rpc.notify`。

+- **params 字段**:方法参数,可以是数组(按顺序)或对象(按名称)。参数可选,不需要时可以省略。

+

+```json

+// 索引数组参数:参数顺序与服务端预期一致

+{"jsonrpc": "2.0", "method": "subtract", "params": [42, 23], "id": 1}

+

+// 命名对象参数:参数名需与服务端方法签名匹配

+{"jsonrpc": "2.0", "method": "subtract", "params": {"minuend": 42, "subtrahend": 23}, "id": 2}

+```

+

+- **id 字段**:客户端生成的唯一标识符,用于关联请求和响应。id 可以是字符串、数值或 null。建议避免使用 null,因为 JSON-RPC 1.0 的通知机制使用 null,可能引起混淆。使用数值作为 id 时,应避免小数。

+

+### 响应对象结构

+

+响应对象是服务端返回给客户端的执行结果:

+

+```json